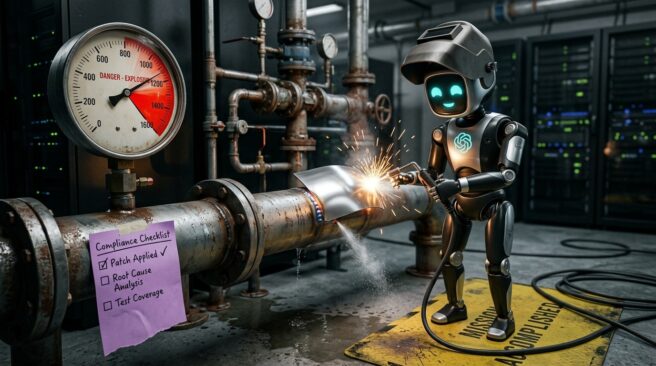

Компания OpenAI анонсировала запуск инициативы Daybreak — специализированной платформы, нацеленной на автоматический поиск и устранение брешей в программном обеспечении. Как сообщает профильное издание Let’s Data Science, проект объединяет возможности новой модели GPT-5.5-Cyber и системы Codex Security для создания превентивной защиты корпоративных цифровых систем.

В основе Daybreak лежит работа автономного агента, который анализирует исходный код организации и выстраивает детальную модель угроз. Система не просто указывает на потенциальные ошибки, но и самостоятельно валидирует наиболее вероятные векторы атак, автоматизируя обнаружение критических рисков. В OpenAI подчеркивают, что Daybreak интегрирует наиболее продвинутые модели с экспертизой партнеров в области кибербезопасности.

Технологический процесс Daybreak отражает современный тренд разделения труда между нейросетями: пока флагманская модель проводит общую разведку и расставляет приоритеты, специализированный инструмент вроде Codex генерирует конкретные исправления (патчи) и создает воспроизводимые тестовые сценарии. Такой подход позволяет минимизировать количество ложноположительных срабатываний, которые долгое время оставались главной проблемой автоматизированных сканеров.

Контекст и конкуренция на рынке киберзащиты

Развертывание Daybreak происходит на фоне успехов других игроков рынка. В частности, проект Glasswing от компании Anthropic уже продемонстрировал впечатляющие результаты: модель Claude Mythos Preview обнаружила тысячи серьезных уязвимостей в популярных операционных системах и браузерах. Использование подобных инструментов в приватном режиме с государственными и коммерческими партнерами становится стандартом индустрии.

Появление Daybreak официально закрепляет статус больших языковых моделей (LLM) как технологий двойного назначения. Способность нейросетей одинаково эффективно писать эксплойты и защитные патчи заставляет разработчиков внедрять все более сложные механизмы контроля. Для инженеров на местах это означает необходимость интеграции ИИ-агентов непосредственно в CI/CD пайплайны, что неизбежно порождает вопросы о прозрачности аудита и безопасности самих исправлений.

Передача ключей от безопасности систем в руки моделей, чьи методы поиска уязвимостей остаются «черным ящиком», выглядит как попытка тушить пожар бензином, пусть и очень высокотехнологичным. Daybreak впечатляет скоростью генерации патчей, но отсутствие четких механизмов верификации логики ИИ превращает автоматическую защиту в потенциальную точку отказа. Пока OpenAI не предложит инструменты глубокого аудита для экспертов, мы рискуем заменить человеческие ошибки на более масштабные и трудноуловимые галлюцинации алгоритмов.

В ближайшее время профессиональному сообществу стоит обратить внимание на то, как именно OpenAI планирует реализовывать сквозную валидацию предложенных исправлений. Ключевым фактором доверия станет возможность внешних исследователей проверять результаты работы Daybreak и соблюдение установленных протоколов ответственного разглашения данных об уязвимостях.

Несмотря на оптимистичные заявления о «заплатках до того, как их найдут хакеры», реальная эффективность Daybreak будет зависеть от глубины интеграции с существующими инструментами разработки. Ирония ситуации заключается в том, что по мере совершенствования защитных моделей, злоумышленники получают в свое распоряжение зеркальные инструменты, превращая кибербезопасность в бесконечную гонку вооружений между идентичными алгоритмами.

Оставить комментарий