Оглавление

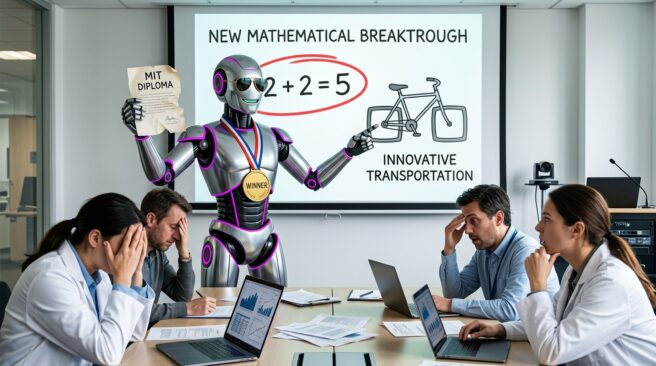

Проблема «уверенного бреда» больших языковых моделей (LLM) остается одним из главных барьеров для их внедрения в критически важные отрасли. Существующие методы самопроверки часто не справляются, когда модель систематически ошибается, сохраняя при этом высокую внутреннюю убежденность. Как сообщает MIT News, группа исследователей Массачусетского технологического института разработала новую метрику, которая выявляет избыточную самоуверенность ИИ через кросс-модельное сравнение.

Традиционный подход к оценке неопределенности — self-consistency — строится на многократном прогоне одного и того же промта через одну модель. Если ответы совпадают, считается, что нейросеть «уверена». Однако практика показывает, что LLM могут быть стабильно неправы. Разработка MIT переносит фокус с внутренней непротиворечивости на эпистемическую неопределенность, измеряя расхождения между результатами нескольких разных моделей.

Разделение алеаторной и эпистемической неопределенности

В основе работы лежит разделение типов ошибок. Алеаторная неопределенность отражает внутреннюю неуверенность модели в конкретном ответе. Эпистемическая неопределенность указывает на фундаментальное несоответствие архитектуры или обучающих данных решаемой задаче. Исследователи обнаружили, что именно второй тип лучше коррелирует с фактическими ошибками в сложных сценариях.

Метод, предложенный Кимией Хамидие и ее коллегами, заключается в создании небольшого ансамбля из архитектурно близких, но независимо обученных моделей (например, комбинация ChatGPT, Claude и Gemini). Если целевая модель выдает ответ, который семантически расходится с мнениями «коллег», система маркирует его как потенциально недостоверный, даже если сама модель оценивает свою уверенность на максимум.

«Если я спрошу ChatGPT об одном и том же несколько раз и получу идентичный ответ, это еще не гарантирует истину. Но если я переключусь на Claude или Gemini и получу другой результат, это даст реальное представление об эпистемической неопределенности», — говорит Кимия Хамидие, ведущий автор исследования.

Эффективность метрики Total Uncertainty

Команда MIT объединила показатели самосогласованности и кросс-модельного расхождения в единую метрику — Total Uncertainty (TU). Тестирование на десяти прикладных задачах, включая математические рассуждения и ответы на вопросы, показало, что TU значительно превосходит стандартные методы детекции галлюцинаций. Примечательно, что новый подход требует меньше вычислительных ресурсов, так как зачастую нуждается в меньшем количестве запросов, чем традиционный перебор вариантов внутри одной модели.

Метод ансамблирования для детекции галлюцинаций — это признание того, что «интеллект» современных LLM остается статистическим эхом, а не пониманием сути. Использование кросс-модельной проверки эффективно купирует симптомы самоуверенности, но не лечит саму болезнь — отсутствие верифицируемой базы знаний. Для индустрии это означает усложнение стека: теперь вместо одной модели придется оплачивать и поддерживать «консилиум», что ставит под вопрос экономическую целесообразность простых чат-ботов в пользу узкоспециализированных систем. Очередной костыль, пусть и высокотехнологичный.

Несмотря на успех в задачах с однозначными ответами, исследователи признают ограничения метода в открытых творческих запросах, где вариативность ответов является нормой, а не признаком ошибки. Тем не менее, для финансового и медицинского секторов внедрение эпистемического контроля может стать обязательным стандартом безопасности при эксплуатации генеративных систем.

Оставить комментарий