Оглавление

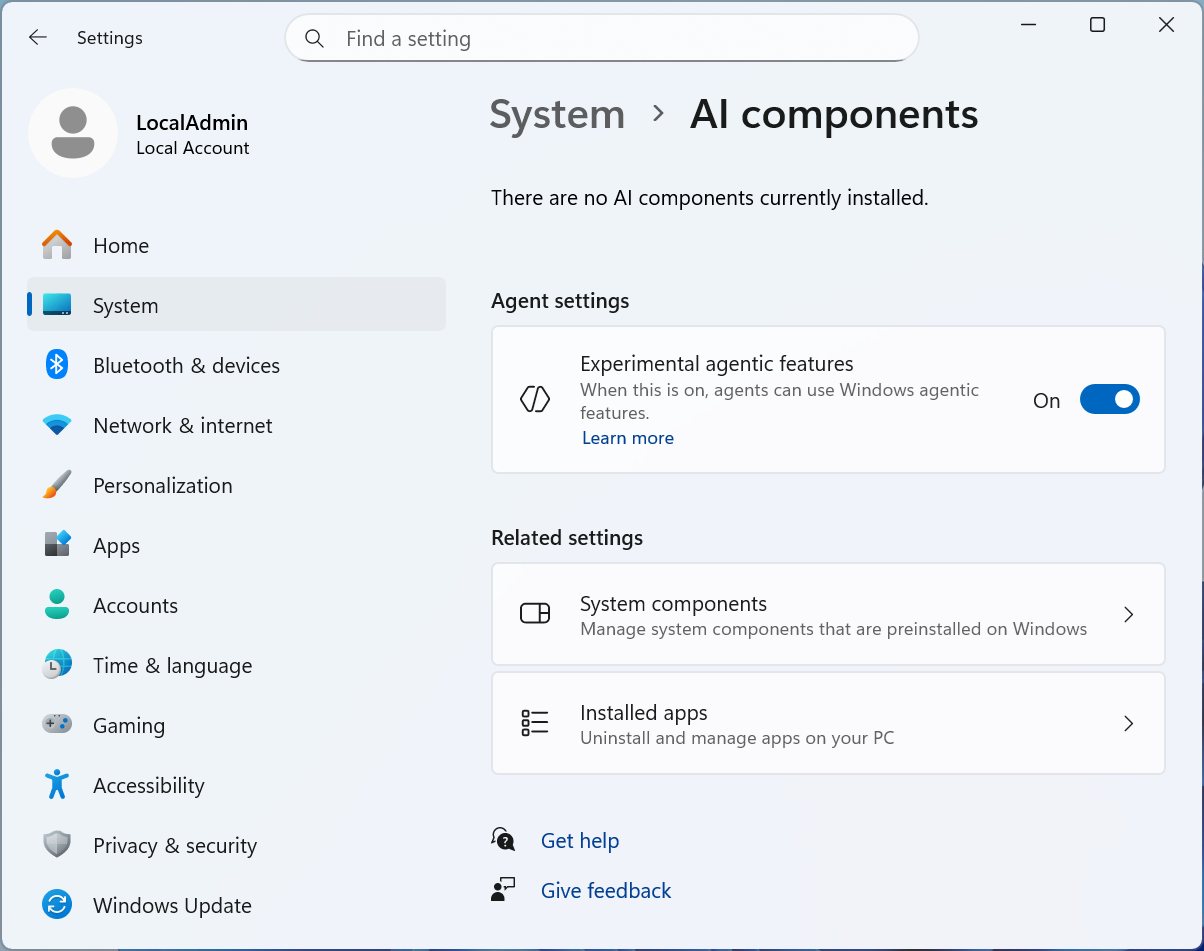

Microsoft продолжает агрессивно внедрять искусственный интеллект в Windows 11, переходя от простых генеративных функций к полноценным автономным агентам. Новая сборка для тестеров программы Windows Insider включает переключатель «экспериментальных агентских функций» для поддержки Copilot Actions — системы, которая должна работать в фоновом режиме и выполнять задачи без постоянного контроля пользователя.

Что такое ИИ-агенты и какие риски они несут

В отличие от обычных ИИ-помощников, эти агенты предназначены для выполнения многоэтапных задач в фоне: организация файлов, планирование встреч, отправка электронных писем. Microsoft позиционирует их как «активных цифровых помощников», способных выполнять сложные задачи для повышения эффективности и продуктивности.

Однако компания прямо признает, что эти агенты создают «новые риски безопасности», связанные с возможностью злоумышленников давать им инструкции. Проблема в том, что AI-агенты склонны к ошибкам и конфабуляциям — они могут уверенно действовать, даже когда не понимают, что делают.

Три ключевые платформенные возможности

В основе видения Microsoft лежат три новые возможности платформы, которые входят в предварительную версию и фундаментально меняют то, как агенты работают в Windows:

- Agent Connectors — нативная поддержка Model Context Protocol (MCP), открытого стандарта от Anthropic, позволяющего AI-агентам подключаться к внешним инструментам и источникам данных

- Agent Workspace — изолированная, контролируемая политиками и аудируемая среда, где агенты могут взаимодействовать с программным обеспечением

- Windows 365 для агентов — расширение этой инфраструктуры до облака, превращающее Cloud PC в среду выполнения для агентов

Microsoft создала так называемый «реестр на устройстве» — защищенное управляемое хранилище, где разработчики могут регистрировать возможности своих приложений как коннекторы для агентов, делая их обнаруживаемыми для любого совместимого агента в системе.

Меры безопасности и их ограничения

Microsoft пытается минимизировать риски несколькими способами:

- Агенты работают под отдельными пользовательскими аккаунтами

- Им предоставляется собственный «рабочий стол», не мешающий пользователю

- Требуется подтверждение доступа к данным

- Все действия агентов логируются и отличаются от пользовательских

- Показывается список планируемых действий для многошаговых задач

Несмотря на эти меры предосторожности, агенты получают доступ к чтению и записи большинства файлов в пользовательском аккаунте — по умолчанию ко всем папкам Документов, Загрузок, Рабочего стола, Музыки, Изображений и Видео. Они также имеют доступ к приложениям, установленным для всех пользователей системы.

Конкретные угрозы

Microsoft специально упоминает угрозу «кросс-промпт инъекций (XPIA)», когда вредоносный контент в элементах интерфейса или документах может переопределить инструкции агента, приводя к непреднамеренным действиям вроде эксфильтрации данных или установки malware.

История с Windows Recall явно научила Microsoft осторожности — теперь они хотя бы предупреждают о рисках заранее. Но сама концепция автономных AI-агентов с доступом к файловой системе выглядит как мечта для создателей вредоносного ПО. Остается надеяться, что когда эти функции выйдут в релиз, они останутся отключенными по умолчанию, а не станут очередным навязчивым «улучшением», которое нужно вручную выключать после чистой установки системы.

Параллельно с разработкой агентов Microsoft работает над «очеловечиванием» Copilot, добавляя анимированного персонажа по имени Mico, напоминающего старого доброго Clippy, и улучшая распознавание голосового ввода.

По материалам Ars Technica

Оставить комментарий