Оглавление

Современные мультимодальные модели искусственного интеллекта успешно справляются с распознаванием объектов, описанием сцен и ответами на вопросы об изображениях и коротких видеороликах, но сталкиваются с трудностями при работе с длинными видео и крупномасштабными визуальными данными, где реальное мышление требует выхода за рамки простого распознавания объектов и анализа коротких клипов.

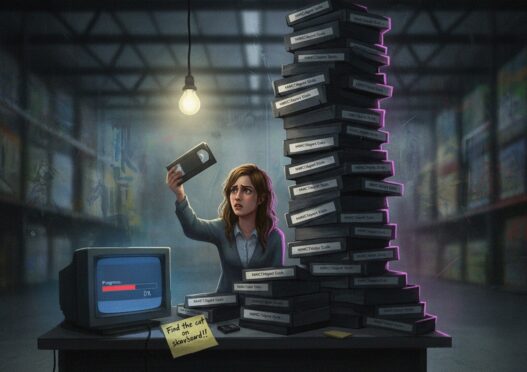

Проблема длинных видео и больших коллекций

Реальное мышление всё чаще включает анализ длинных видео, где контекст охватывает минуты или часы, что значительно превышает лимиты контекста большинства моделей. Также оно подразумевает запросы по огромным мультимодальным библиотекам видео, изображений и транскриптов, где поиск и интеграция релевантных доказательств требует большего, чем просто извлечение — требуется стратегическое мышление. Существующие модели обычно выполняют однопроходный вывод, производя одноразовые ответы. Это ограничивает их способность справляться с задачами, требующими временного мышления, кросс-модальной привязки и итеративного уточнения.

MMCTAgent: архитектура с критическим мышлением

Для решения этих проблем Microsoft разработала Multi-modal Critical Thinking Agent или MMCTAgent для структурированного мышления над длинными видео и данными изображений, доступную на GitHub и представленную в Azure AI Foundry Labs.

Построенная на основе AutoGen, открытой мультиагентной системы Microsoft, MMCTAgent предоставляет мультимодальные вопросы и ответы с архитектурой Планировщик–Критик. Эта конструкция позволяет планировать, отражать и использовать инструментальное мышление, соединяя восприятие и обдумывание в мультимодальных задачах. Она связывает язык, зрение и временное понимание, преобразуя статические мультимодальные задачи в динамические рабочие процессы мышления.

В отличие от традиционных моделей, которые производят одноразовые ответы, MMCTAgent имеет модально-специфичных агентов, включая ImageAgent и VideoAgent, которые содержат инструменты типа get_relevant_query_frames() или object_detection-tool(). Эти агенты выполняют продуманное, итеративное мышление — выбирая правильные инструменты для каждой модальности, оценивая промежуточные результаты и уточняя выводы через цикл Критика. Это позволяет MMCTAgent анализировать сложные запросы по длинным видео и большим библиотекам изображений с объяснимостью, расширяемостью и масштабируемостью.

Как работает MMCTAgent

MMCTAgent интегрирует двух скоординированных агентов, Планировщика и Критика, управляемых через AutoGen. Агент Планировщик декомпозирует пользовательский запрос, идентифицирует соответствующие инструменты мышления, выполняет мультимодальные операции и составляет предварительный ответ. Агент Критик проверяет цепочку мышления Планировщика, подтверждает соответствие доказательств и уточняет или пересматривает ответ для фактической точности и согласованности.

Этот итеративный цикл мышления позволяет MMCTAgent улучшать свои ответы через структурированную самооценку — внедряя рефлексию в ИИ-мышление. Ключевая сила MMCTAgent заключается в её модульной расширяемости. Разработчики могут легко интегрировать новые, доменно-специфичные инструменты — такие как анализаторы медицинских изображений, модели промышленного контроля или специализированные модули извлечения — добавляя их в ImageQnATools или VideoQnATools. Этот дизайн делает MMCTAgent адаптируемой через домены.

VideoAgent расширяет эту архитектуру для мышления над длинными видео. Он работает в двух связанных фазах: создание библиотеки (приём) и мышление во время запроса.

Фаза 1 – Приём видео и создание библиотеки

До начала мышления длинные видео проходят через конвейер приёма, который согласует мультимодальную информацию для извлечения и понимания:

- Транскрипция и перевод: преобразует аудио в текст и, если многоязычное, переводит транскрипты на единый язык

- Идентификация ключевых кадров: извлекает репрезентативные кадры, отмечающие основные визуальные или сценарные изменения

- Семантическое сегментирование и генерация глав: объединяет сегменты транскрипта и визуальные сводки в связные, семантически сегментированные главы с соответствующими ключевыми кадрами. Вдохновлённый агентическим инструментом поиска Deep Video Discovery от Microsoft, этот шаг также извлекает детальные описания объектов, текста на экране и персонажей, присутствующих в каждом сегменте видео, интегрируя эти инсайты непосредственно в соответствующие главы.

- Создание мультимодальных эмбеддингов: генерирует эмбеддинги изображений для ключевых кадров, связывая их с соответствующими данными транскрипта и главы

Вся структурированная метаданная, включая транскрипты, визуальные сводки, главы и эмбеддинги, индексируется в Мультимодальной Базе Знаний с использованием Azure AI Search, которая формирует основу для масштабируемого семантического извлечения и последующего мышления.

Фаза 2 – Ответы на вопросы по видео и мышление

Когда пользователь отправляет запрос, VideoAgent извлекает, анализирует и мыслит по индексированному видеоконтенту, используя специализированные инструменты планировщика и критика.

Инструменты Планировщика

- get_video_analysis: находит наиболее релевантное видео, предоставляет сводку и список обнаруженных объектов

- get_context: извлекает контекстуальную информацию и релевантные главы из индекса Azure AI Search

- get_relevant_frames: выбирает ключевые кадры, наиболее релевантные пользовательскому запросу

- query_frame: выполняет детальное визуальное и текстовое мышление над выбранными кадрами

- get_context и get_relevant_frames работают в тандеме, чтобы обеспечить начало мышления с наиболее семантически релевантных доказательств

Инструмент Критика

- critic_tool: оценивает вывод мышления на временное соответствие, фактическую точность и связность между визуальными и текстовыми модальностями

Этот двухфазный дизайн, который включает структурированный приём с последующим агентическим мышлением, позволяет MMCTAgent предоставлять точные, интерпретируемые инсайты для длинных информационно-насыщенных видео.

ImageAgent: Структурированное мышление для статических визуалов

В то время как VideoAgent обрабатывает временное мышление по длинным видео, ImageAgent применяет ту же парадигму Планировщик–Критик к статическому визуальному анализу. Он выполняет модульное, инструментальное мышление над изображениями, комбинируя инструменты восприятия для распознавания, обнаружения и оптического распознавания символов с языковым мышлением для интерпретации и объяснения.

Инструменты Планировщика

- vit_tool: использует Vision Transformer (ViT) или Vision Language Model (VLM) для высокоуровневого визуального понимания и описания

- recog_tool: выполняет распознавание сцен, лиц и объектов

- object_detection_tool: локализует и маркирует сущности внутри изображения

- ocr_tool: извлекает встроенный текст из визуальных элементов

Инструмент Критика

- critic_tool: проверяет выводы Планировщика на соответствие фактам и согласованность, уточняя финальный ответ

Этот легковесный ImageAgent предоставляет детальное, объяснимое мышление над коллекциями изображений — поддерживая визуальные вопросы и ответы, проверку контента и мультимодальное извлечение — сохраняя архитектурную симметрию с VideoAgent.

Результаты оценки

Чтобы оценить эффективность MMCTAgent, мы протестировали как ImageAgent, так и VideoAgent с несколькими базовыми LLM-моделями и рядом бенчмарк-датасетов и реальных сценариев. Некоторые ключевые результаты представлены здесь.

| Датасеты изображений | GPT-4V | MMCT с GPT-4V | GPT4o | MMCT с GPT-4o | GPT-5 | MMCT с GPT-5 |

|---|---|---|---|---|---|---|

| MM-Vet [1] | 60.20 | 74.24 | 77.98 | 79.36 | 80.51 | 81.65 |

| MMMU [2] | 56.80 | 63.57 | 69.10 | 73.00 | 84.20 | 85.44 |

| Видео датасеты | GPT4o | MMCT с GPT-4o |

|---|---|---|

| VideoMME [3] | 72.10 | 76.70 |

MMCTAgent улучшает производительность базовых моделей, расширяя их возможности соответствующими инструментами, такими как обнаружение объектов и оптическое распознавание символов.

Архитектура агентского мышления MMCTAgent представляет собой фундаментальный сдвиг от одноразовых ответов к структурированному анализу. Интересно, что Microsoft сделала ставку на объяснимость — критик-агент фактически документирует процесс принятия решений, что критически важно для реальных применений в медицине, промышленности и аналитике. Однако возникает вопрос: насколько эта система масштабируема для реального времени? Двухфазный подход с предварительной обработкой видео создает значительные накладные расходы, что может ограничить применение в сценариях с быстрым принятием решений. Тем не менее, для архивного анализа и исследовательских задач это выглядит многообещающе.

По сообщению Microsoft Research, система продолжает развиваться с акцентом на расширение инструментария для специфических доменов и улучшение производительности в реальном времени.

Оставить комментарий