Оглавление

Компания Google анонсировала специализированную модель Gemini 2.5 Computer Use, которая позволяет ИИ-агентам напрямую взаимодействовать с пользовательскими интерфейсами — кликать, вводить текст, заполнять формы и управлять веб-приложениями так, как это делает человек. Модель доступна в превью через API и построена на базе возможностей Gemini 2.5 Pro.

Как работает компьютерное зрение ИИ

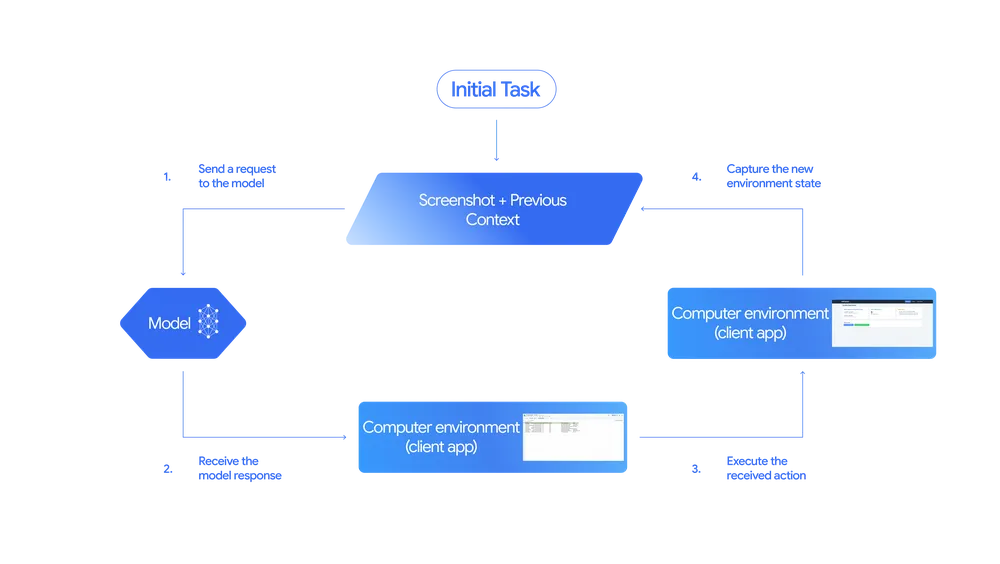

Новая модель использует инструмент computer_use в Gemini API, работающий в циклическом режиме. На вход система получает:

- Пользовательский запрос

- Скриншот интерфейса

- Историю последних действий

Модель анализирует эти данные и генерирует ответ в виде вызова функции — например, клик или ввод текста. После выполнения действия система получает новый скриншот и URL, продолжая цикл до завершения задачи.

Практические примеры применения

В демонстрациях модель успешно справляется со сложными многошаговыми задачами:

Пример 1: «Найти всех питомцев из Калифорнии на сайте pet-care-signup, добавить их в CRM-систему спа и записать на прием к специалисту»

Пример 2: «Организовать хаотичные заметки на виртуальной доске в соответствующие категории»

Производительность и безопасность

Согласно тестам, Gemini 2.5 Computer Use превосходит аналогичные решения в веб- и мобильных бенчмарках при минимальной задержке. Модель оптимизирована в первую очередь для браузеров, но показывает перспективные результаты и в управлении мобильными интерфейсами.

В вопросах безопасности Google реализовал многоуровневую систему защиты:

- Встроенные механизмы безопасности в самой модели

- Сервис проверки каждого действия перед выполнением

- Возможность настройки обязательного подтверждения пользователя для рискованных операций

ИИ-агенты, способные управлять интерфейсами — это естественный следующий шаг после чат-ботов. Интересно, что Google делает ставку на безопасность с самого начала, понимая риски автоматизации действий в веб-среде. Вопрос в том, насколько надежно это работает в реальных условиях, где каждый сайт — это отдельная вселенная с уникальной структурой и поведением. Пока что это выглядит как технология для разработчиков, а не для массового пользователя.

По материалам DeepMind.

Оставить комментарий