Оглавление

Китайская компания DeepSeek выпустила гибридную модель V3.1, которая впервые превзошла собственную специализированную модель для рассуждений R1 в стандартных тестах. Новая архитектура сочетает два режима работы и предлагает радикально низкие цены по сравнению с западными конкурентами.

Гибридный подход по образцу Anthropic

Модель V3.1 развивает предыдущую версию DeepSeek-V3, добавив 840 миллиардов токенов обучения для улучшения работы с длинным контекстом и сложными задачами. Обновлены токенизатор и шаблон чата.

Ключевая особенность — два режима работы:

- Think mode (deepseek-reasoner) — для многошаговых рассуждений и использования инструментов

- Non-think mode (deepseek-chat) — для простых задач и диалога

Оба режима поддерживают контекстное окно в 128 000 токенов. Переключение между режимами происходит через специальный токен </think> в промпте. Пользователи могут испытать функцию в чате DeepSeek через кнопку «DeepThink».

Гибридные модели — это логический эволюционный шаг, но отсутствие вызова функций в режиме рассуждений серьёзно ограничивает их применение в агентных сценариях. DeepSeek демонстрирует усердную инженерную работу, но до полноценной конкуренции с OpenAI и Anthropic в части инструментального мышления еще далеко.

Производительность и ограничения

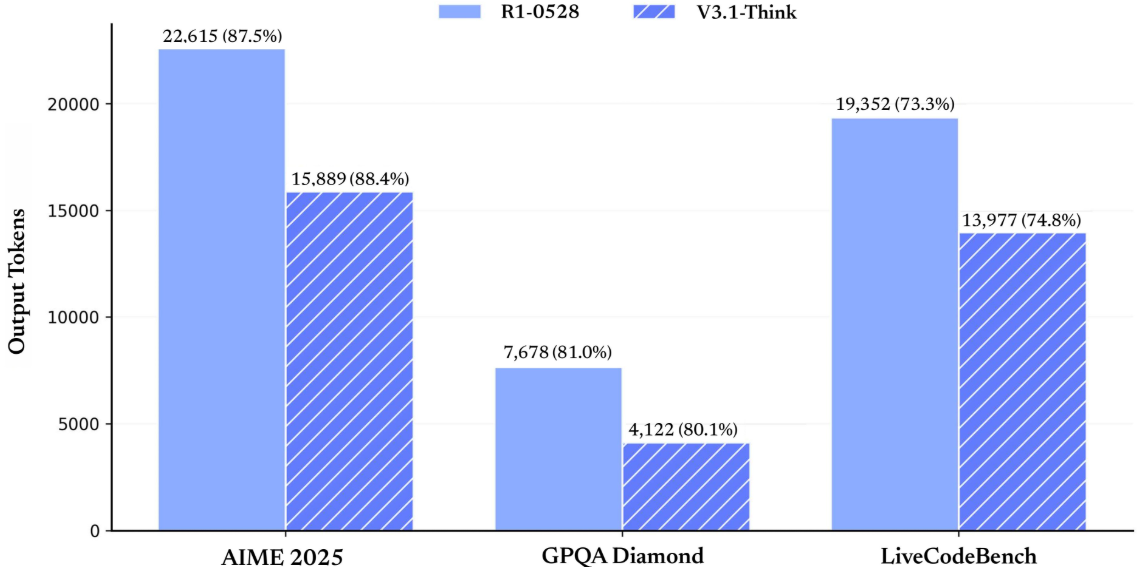

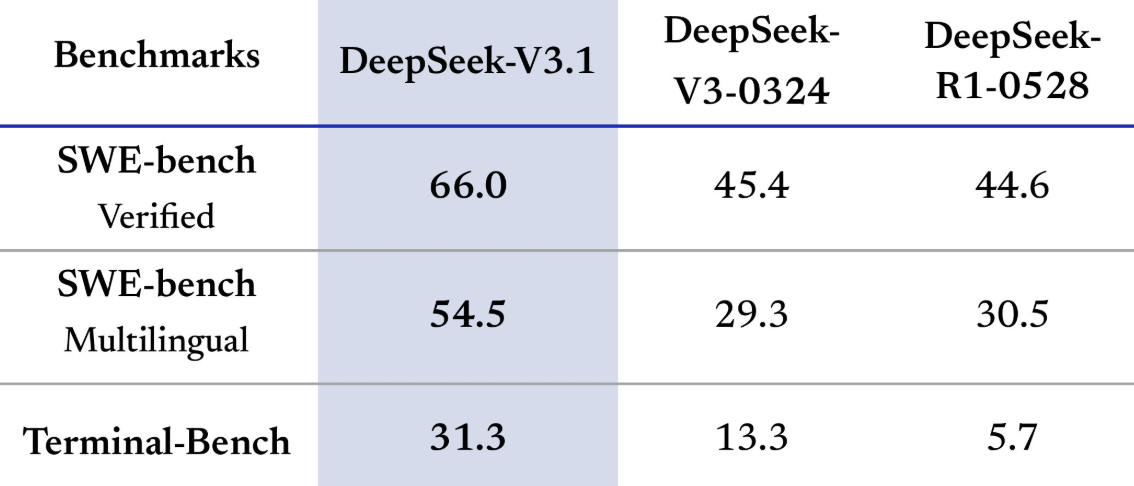

По заявлениям DeepSeek, модель показывает лучшие результаты в бенчмарках SWE и Terminal-Bench с «значительным приростом в эффективности мышления». Think Mode работает быстрее предыдущей модели рассуждений R1. Архитектура не изменилась: 671 миллиард общих параметров, 37 миллиардов активных.

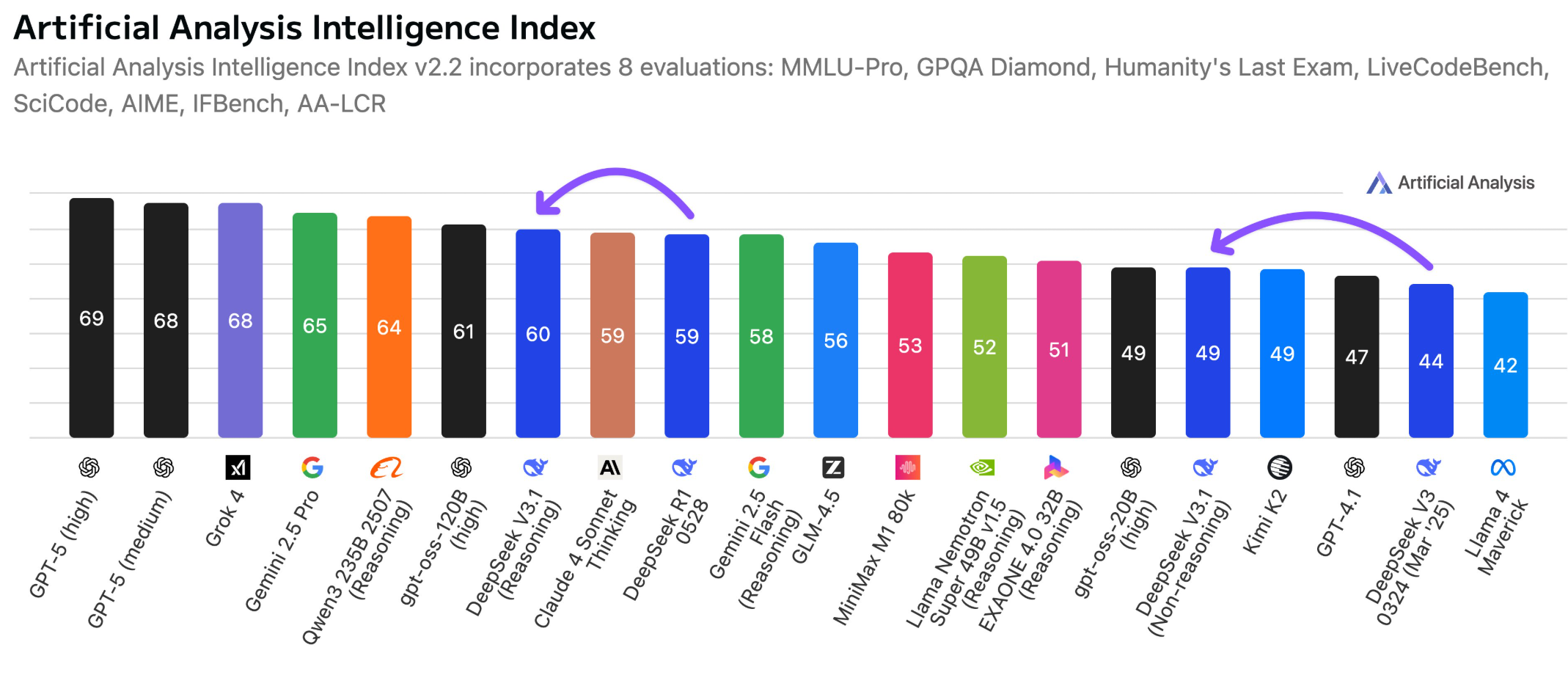

Согласно анализу Artificial Analysis, V3.1 набирает 60 баллов в индексе интеллекта в режиме рассуждений против 59 у R1. Однако модель все еще отстает от последней разработки Alibaba и немного уступает открытой модели рассуждений GPT-OSS от OpenAI.

Критическое ограничение: V3.1 не поддерживает вызов функций в режиме рассуждений, что «существенно ограничивает ее возможность поддерживать агентские рабочие процессы». Конкуренты, такие как GPT-5 Thinking, могут использовать такие инструменты, как анализ изображений или генерация кода внутри цепочки мыслей.

Ценовое превосходство

С 5 сентября 2025 года DeepSeek вводит новую структуру цен:

- Входные токены: $0.07 за миллион при кеш-попаданиях, $0.56 при промахах

- Выходные токены: $1.68 за миллион

Эти тарифы в разы ниже конкурентов:

- Gemini 2.5 Pro: $10.00 за миллион выходных токенов

- OpenAI GPT-5: $10.00 за миллион после снижения цен

- Anthropic Claude Opus 4.1: до $75.00 за миллион

V3.1 доступна через два API-эндпоинта. Поддержка формата Anthropic API и бета-версия строгого вызова функций упрощают разработку. Открытые веса доступны на Hugging Face под лицензией MIT.

Как и другие китайские ИИ-модели, DeepSeek-V3.1 применяет контентные ограничения и адаптирует ответы в соответствии с государственными guidelines. Аналогичные ограничения могут появиться в США, где администрация Трампа продвигает регулирование обработки «woke»-тем, пишет The Decoder.

Оставить комментарий