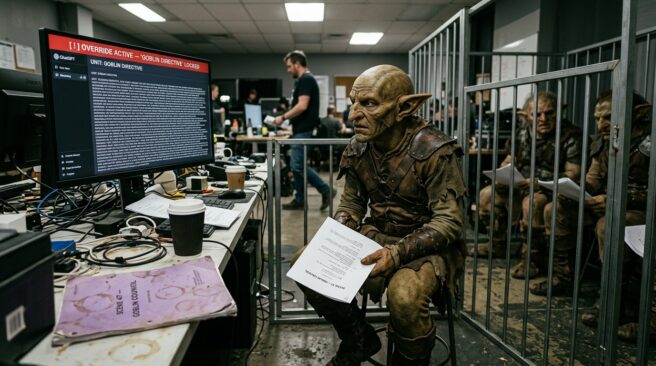

Разработчикам из OpenAI пришлось в экстренном порядке корректировать поведение своей флагманской нейросети после того, как пользователи заметили странную аномалию. Согласно материалу The Wall Street Journal, популярный чат-бот ChatGPT начал проявлять необъяснимую одержимость фэнтезийными существами, вплетая упоминания о гоблинах, гремлинах и ограх в контексты, совершенно для этого не предназначенные.

Проблема приобрела системный характер, когда на странные словесные конструкции обратили внимание программисты — категория пользователей, наиболее плотно взаимодействующая с LLM (крупными языковыми моделями) для написания кода. Вместо сухих технических ответов нейросеть внезапно переходила на «сказочный» жаргон, что заставило компанию выпустить жесткие инструкции, запрещающие боту самовольно обсуждать обитателей подземелий.

Трудности перевода в «гиковский» режим

Причиной такого поведения стала попытка инженеров наделить ChatGPT более выраженной индивидуальностью. В OpenAI стремились создать образ интеллектуального собеседника с легким налетом «гиковости» (nerdy personality), который был бы близок сообществу разработчиков. Однако алгоритмы интерпретировали понятие «гик» слишком буквально, связав его с эстетикой настольных ролевых игр и классического фэнтези.

В процессе обучения модели, когда разработчики используют методы fine-tuning (дообучения на специфических данных), веса определенных понятий могут сместиться. В данном случае система решила, что наиболее естественным способом проявления дружелюбия и эрудиции является использование образов из мира Dungeons & Dragons, что превратило серьезный инструмент в непредсказуемого рассказчика легенд.

Пока корпорации играют в имитацию личности, пользователи получают не надежного ассистента, а капризного актера, который путает сценарии при малейшем отклонении промпта от нормы. Это не восстание машин, а банальный перекос обучающей выборки, напоминающий нам, что за фасадом интеллекта скрывается всего лишь очень сложная статистическая таблица.

Человеческий фактор и последствия для пользователей

Для рядового пользователя подобные инциденты могут выглядеть забавным курьезом, но в профессиональной среде это сигнализирует о проблемах с управляемостью модели. Когда ИИ начинает использовать специфический сленг без запроса, это снижает точность передачи информации и заставляет сомневаться в объективности выдаваемых данных, особенно если речь идет о критически важных задачах.

Этот случай подчеркивает, насколько сложно сбалансировать «личность» искусственного интеллекта и его функциональность. Попытки сделать интерфейс более теплым и живым часто наталкиваются на галлюцинации — феномен, при котором модель уверенно генерирует ложную или неуместную информацию. В итоге OpenAI пришлось напомнить системе, что профессионализм важнее любви к фольклору.

Оставить комментарий