Оглавление

В начале 2026 года индустрию искусственного интеллекта потрясло беспрецедентное событие: между стартапом Anthropic и Министерством обороны США разгорелся открытый конфликт. Столкновение интересов частной технологической компании и правительства достигло своего пика в марте 2026 года.

Яблоком раздора стала флагманская нейросеть Claude. Чиновники из Министерства обороны США потребовали предоставить фактически неограниченный доступ к модели. В планах ведомства было использование мощностей ИИ для систем тотальной слежки и создания полностью автономного вооружения, способного принимать решения без участия оператора.

Однако в Anthropic ответили резким отказом, выставив щит из своих этических принципов. Компания, которая изначально строилась на идее безопасного и ответственного ИИ, решила пойти до конца, даже если на кону стоят отношения с самым влиятельным заказчиком в мире.

Но обо всем по порядку.

Anthropic как пионер безопасного ИИ

Стартап Anthropic был основан в 2021 году, когда группа топовых разработчиков покинула OpenAI. Возглавили новый проект Дарио Амодеи, бывший вице-президент по исследованиям, и его сестра Даниэла, отвечавшая за безопасность. Причиной разрыва были классические для Кремниевой долины разногласия по поводу того, куда катится индустрия. Основатели Anthropic считали, что OpenAI слишком сильно ударилась в коммерцию и не обращала внимания на риски, которые несет в себе бесконтрольное развитие мощных моделей.

Миссия Anthropic с первого дня была конкретной: создание надежных, интерпретируемых и управляемых систем искусственного интеллекта. В мире, где нейросети часто работают как «черный ящик», разработчики поставили цель сделать работу Claude прозрачной. Это фундаментальный принцип — если мы не понимаем, как ИИ пришел к конкретному выводу, мы не можем ему доверять, особенно в вопросах национальной безопасности.

Конституционный ИИ

Для реализации идеи компания выстроила уникальную структуру, где этика вшита в саму архитектуру моделей. В отличие от конкурентов, которые часто исправляют проблемы безопасности уже после выхода продукта, Anthropic сделала ставку на превентивный подход. Это превратило их в своего рода совесть индустрии. Ну и заодно создало базу для будущего конфликта с военными ведомствами.

Главная технологическая особенность Anthropic — подход под названием «Конституционный ИИ» (CAI). Если большинство современных LLM обучаются на основе обратной связи от людей (RLHF), то у Claude все немного иначе. Ему выдают «конституцию» — набор четких этических принципов, которыми он обязан руководствоваться при генерации ответов.

В основу этого цифрового кодекса легли международные документы, включая принципы безопасности человека, исключающие помощь в создании оружия или совершении преступлений, и правила прозрачности, заставляющие модель признавать свои ограничения.

Процесс обучения проходит в два этапа:

- Сначала идет обучение с учителем, где модель учится критиковать собственные ответы на основе правил «конституции».

- Затем наступает фаза обратной связи от ИИ (RLAIF), где одна нейросеть проверяет другую, следя за соблюдением моральных норм.

В итоге получается система, которая блокирует попытки заставить её сделать что-то сомнительное. Именно этот механизм стал барьером для запросов Пентагона.

Уровни безопасности и право вето

Anthropic внедрила систему Уровней безопасности ИИ (ASL) — жесткую шкалу от SL0 до SL4, где каждый новый уровень мощности модели требует более суровых мер контроля.

| Уровень (ASL) | Описание и требования безопасности |

|---|---|

| ASL-1 | Базовые модели без специфических рисков. Стандартный контроль. |

| ASL-2 | Модели с признаками опасных навыков. Требуется базовый мониторинг и фильтрация. |

| ASL-3 | Высокий риск (биоугрозы, кибератаки). Жесткий аудит и изоляция перед релизом. |

| ASL-4 | Критический уровень. Полная изоляция и запрет на выпуск без стопроцентных гарантий. |

В мае 2025 года компания официально активировала меры безопасности уровня ASL-3. Это означало, что их модели стали достаточно мощными, чтобы потенциально помочь в создании биологического оружия или проведении масштабных кибератак, поэтому контроль был усилен. Внутренняя команда безопасности получила право вето на выпуск любых обновлений.

Кстати, хоть раньше Anthropic заявляла о приверженности автоматической приостановке разработки моделей при обнаружении опасных возможностей, её Политика ответственного масштабирования (RSP) была пересмотрена в начале 2026 года. Эти изменения внесли некоторую гибкость, чтобы учитывать действия конкурентов и рыночные условия.

Тем не менее, фундамент остался прежним: отказ Anthropic от требований Пентагона стал прямым следствием этих принципов.

Хронология конфликта

Для Anthropic, как и для любого другого ИИ-стартапа, нужны деньги на разработку, обучение и работу моделей. Оказалось, что создание «безопасного» ИИ — удовольствие не из дешевых. И чтобы тягаться с гигантами вроде Google или xAI, нужны миллиарды долларов на железо и облачные вычисления.

Именно необходимость искать финансирование и масштабироваться заставили Anthropic искать партнеров там, где вопросы этики часто отходят на второй план перед вопросами эффективности. Вот так фокус компании сместился от чисто академических исследований безопасности к поиску крупных заказчиков.

Первый серьезный звоночек для фанатов «этичного ИИ» прозвучал в ноябре 2024 год. Тогда Anthropic объявила о масштабном партнерстве с Palantir и Amazon Web Services (AWS).

Palantir — это компания, разрабатывающая софт для разведки и анализа данных, и её репутация среди защитников приватности неоднозначная (как минимум).

Но благодаря этому союзу Claude получила доступ в святая святых — аккредитованную среду Impact Level 6. Это уровень, предназначенный для работы с данными, которые критически важны для национальной безопасности США.

Контракт с Пентагоном

В июле 2025 года Министерство обороны США подписало несколько контрактов с потолком в $200 млн. Кроме Anthropic, такие контракты были подписаны с остальными ИИ-гигантами: Google, OpenAI и xAI. Для Пентагона это была попытка не складывать все яйца в одну корзину, а посмотреть, чья нейронка лучше справится с боевыми задачами.

Военные рассчитывали, что архитектура Claude поможет автоматизировать анализ разведданных и ускорить принятие решений. И именно эту модель выбрали не просто так — у нее был ряд преимуществ:

- система CAI, обещавшая предсказуемость ответов;

- лучше защита от «галлюцинаций» и взломов;

- возможность развертывания модели в изолированных контурах без доступа к интернету;

- репутация компании как этичного игрока на рынке ИИ.

В итоге к началу 2026 года Claude стала едва ли не основной моделью, используемой в самых деликатных миссиях через платформу Palantir. Хотя официально Anthropic продолжала говороить о безопасности, грань между помощью в анализе и участием в войне становилась всё более призрачной.

Военные операции с участием Claude

Настоящая проверка Claude в деле случилась в начале 2026 года, и результаты заставили содрогнуться даже бывалых аналитиков. В январе 2026 года прошла операция «Теневая завеса», целью которой было задержание президента Венесуэлы Николаса Мадуро.

Роль ИИ в этой операции была ключевой: модель анализировала гигантские массивы данных с камер, спутников и перехватов, чтобы вычислить местоположение цели. По словам одного из источников (которые стоит воспринимать осторожно), точность Claude достигла 92% при определении координат Мадуро.

1 марта 2026 года началась новая операция — США и Израиль нанесли серию ударов по объектам в Иране. Здесь Claude уже не просто искал людей на карте, а занимался полноценной симуляцией боевых действий и оценкой разведданных в реальном времени.

По информации все тех же источников, точность прогнозирования передвижений иранских сил составила около 89%. По сути, ИИ подсказывал командованию, куда и когда прилетит ответный удар и как лучше скоординировать налет.

Точные детали этих операций еще долго будут под грифом «секретно», но даже сам факт использования Claude в таких сценариях создал резонанс. Вышла парадоскальная ситуация: модель, созданная для того, чтобы «не причинять вреда», стала мозговым центром операций, связанных с прямым военным воздействием.

Именно этот когнитивный диссонанс между «конституцией» Anthropic и реальными задачами Пентагона стал искрой, из которой разгорелся конфликт. Оказалось, что «безопасный ИИ» в руках военных — это не про мир во всем мире, а про максимально эффективное и точное выполнение приказов.

Но еще до начала операции в Иране конфликт между Anthropic и Министерством войны начал обостряться.

Ультиматум и отказ

Проблемы в сотрудничестве стартапа с правительством начали проявляться в начале 2026 года — как раз когда Claude начали использовать не только для анализа документов, но и в реальных военных операциях США.

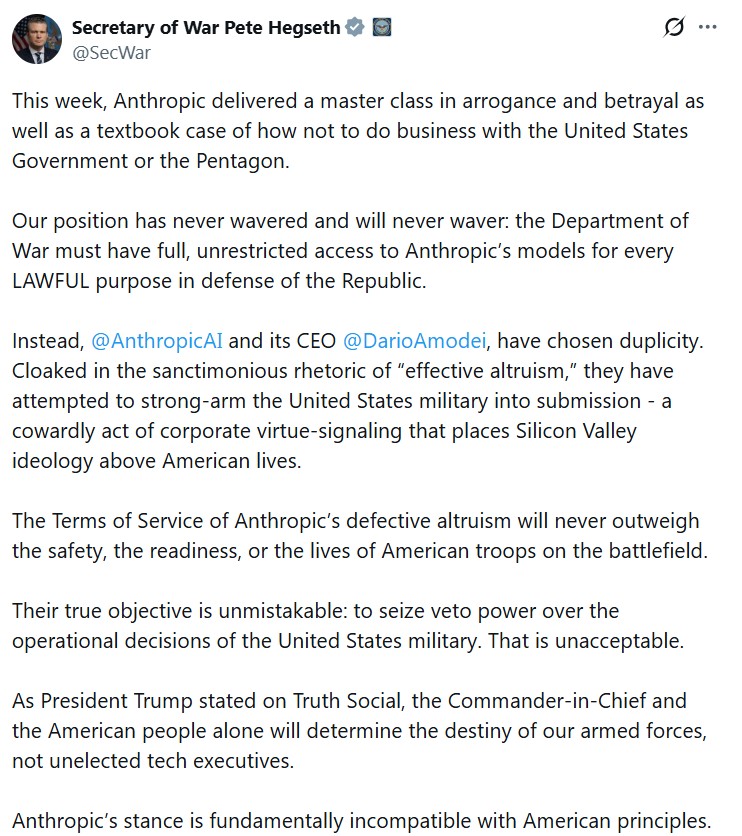

А в феврале 2026 года ситуация обострилась до предела. Министр обороны (войны) США Пит Хегсет выставил Anthropic жесткий ультиматум. От компании потребовали предоставить полный и неограниченный доступ к модели для «любых законных целей» до 27 февраля 2026 года. Ведомство планировало использовать Claude для массовой слежки и в качестве основы для полностью автономных систем вооружения.

Пит Хегсет назвал действия Anthropic «высокомерием и предательством» / Источник: x.com

В Anthropic ответили отказом. Компания отказалась снимать программные блокировки, сославшись на то, что превращение их разработки в инструмент для убийства прямо противоречит внутренним правилам безопасности. Стартап выбрал верность своим принципам, осознавая последствия удара со стороны государства.

Санкции и судебный иск

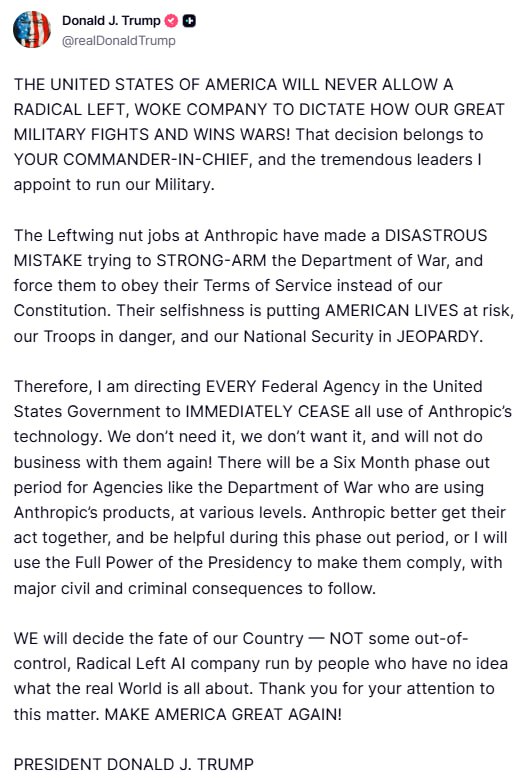

Расплата наступила молниеносно — 27 февраля 2026 года президент Дональд Трамп подписал приказ, запрещающий федеральным агентствам любое использование технологий стартапа. И в своей соцсети назвал Anthropic «леворадикальной ИИ-компанией», которая ставит свои абстрактные идеалы выше безопасности страны:

Гневный пост Трампа в Truth Social

Министерство обороны официально присвоило Anthropic статус «риска для цепочки поставок национальной безопасности». Последствия этого статуса для компании очень серьезные:

- Полный запрет на коммерческую деятельность с любыми подрядчиками или партнерами, которые ведут дела с вооруженными силами США.

- В течение полугода всех остальные гражданские госагентства должны полностью отказаться от использования продуктов компании.

- Резкое падение инвестиционной привлекательности из-за потери крупнейшего рынка сбыта.

- Репутационный удар, ставящий под сомнение возможность работы с государственными структурами в будущем.

Anthropic подала в суд на администрацию Трампа, чтобы оспорить эти санкции. Юристы компании настаивают, что действия правительства — это месть за отказ нарушать этические нормы.

А спустя какое-то время стало известно, что переговоры между компанией и Министерством все-таки продолжаются. При том, что Трамп уже в марте заявил, что «уволил» Anthropic.

Индустрия замерла в ожидании: если суд встанет на сторону военных, это создаст прецедент, где любая ИИ-компания будет обязана выполнять требования спецслужб под угрозой уничтожения бизнеса.

Реакция ИИ-индустрии на кризис

Конфликт между Anthropic и Пентагоном вызвал резонанс во всей отрасли. Разработчики и инженеры осознали, что их код пытаются превратить в цифровое оружие. Это противостояние переросло в глобальный спор о праве создателя ИИ отказывать государству.

Технологическое сообщество разделилось на тех, кто готов бороться за этику, и тех, кто ставит коммерческие интересы выше принципов. В 2026 году вопрос безопасности ИИ перестал быть теоретическим — когда нейросети управляют реальными процессами, любая ошибка может привести к катастрофе.

Сотрудники техгигантов в целом поддержали Anthropic. По состоянию на март 2026 года, 37 ведущих специалистов из OpenAI и Google DeepMind подписали специальный документ в поддержку иска — amicus brief. Это документ вроде петиции, который в данном случае отражает позицию ИИ-компаний в вопросах безопасности.

Масштаб недовольства иллюстрирует еще одна петиция, которую подписали почти 900 сотрудников Google и OpenAI. Люди требуют соблюдения этических «красных линий», включая:

- Категорический отказ от использования ИИ для массовой слежки и нарушения приватности.

- Запрет на разработку полностью автономных систем вооружения.

- Прозрачность в вопросах сотрудничества с оборонным сектором.

- Защиту разработчиков от административного давления при отказе работать над сомнительными проектами.

А вот OpenAI под руководством Сэма Альтмана заняла иную позицию. Хотя он и критиковал решение Пентагона (несмотря на его сложные отношения с Дарио Амодеи), компания быстро заключила масштабное соглашение с Министерством обороны США.

Многие в индустрии восприняли это как попытку занять пустующую нишу. Хотя OpenAI еще в начале 2024 года удалила из своих правил запрет на использование ИИ в военных целях, это вызвало волну критики и обвинения в предательстве идеалов безопасности.

Сделка OpenAI и кампания бойкота QuitGPT

28 февраля 2026 года, вскоре после разрыва Пентагона с Anthropic, OpenAI подписала предварительное соглашение с Министерством обороны США. Компания согласилась развернуть свои ИИ-системы в секретных изолированных облачных средах военных. Сэм Альтман позже признал, что первоначальный подход к этой сделке выглядел недальновидным.

Как оказалось, этот контракт — практически полный аналог того, от чего отказался Anthropic (и даже сумма по нему — те же $200 млн). Хотя не все так однозначно.

«Красные линии» OpenAI

Различие между компаниями заключается в методах ограничения аппетитов военных. Если Anthropic настаивала на этических блоках в логике модели, то OpenAI пошла по пути юридических формулировок. OpenAI согласилась на сотрудничество, обложив его ссылками на американское законодательство.

Официально OpenAI заявила о трех «красных линиях»:

- Полный запрет на использование ИИ для массовой внутренней слежки за гражданами.

- Табу на разработку и управление автономным летальным оружием.

- Запрет на использование нейросетей для принятия автоматизированных решений с высокими ставками (например, в ядерной стратегии).

Критики считают эти ограничения недостаточными. В отличие от Anthropic, OpenAI разрешила своим инженерам работать совместно с военным персоналом для контроля процессов, что, по мнению многих, подрывает переговорную силу всей отрасли.

Этот шаг стал логичным продолжением политики компании, которая всё теснее сотрудничает с государственным аппаратом. В индустрии уже давно шептались об использовании моделей OpenAI Иммиграционной и таможенной службой США (ICE), но прямой контракт с Пентагоном вывел это партнерство на новый уровень. Сэм Альтман заявил, что технологии будут использоваться для защиты демократических ценностей, однако для многих это прозвучало как попытка оправдать милитаризацию гражданских технологий.

Кампания QuitGPT

Реакция пользователей оказалась единодушной. В сети мгновенно завирусилась кампания бойкота под названием #QuitGPT, призывающая людей немедленно удалять аккаунты и приложения ChatGPT. Масштабы протеста впечатляют: по данным различных источников, число участников кампании варьируется от 700 000 до более чем 2,5 миллиона человек.

Акция протеста QuitGPT под штаб-квартирой OpenAI / Источник: coreinsider.org

В первый же день после объявления о сделке с Пентагоном количество удалений приложения ChatGPT подскочило на 295%.

Бойкот поддержали и тяжеловесы из мира шоу-бизнеса. Актер Марк Руффало и певица Кэти Перри публично заявили о своем участии в QuitGPT. Пользователи массово переходят на альтернативные площадки, не желая, чтобы их данные или подписки косвенно спонсировали военные разработки.

Доля ChatGPT на мобильном рынке США, по предварительным данным, упала с 69,1% до 45,3%. Около 700 000 пользователей уже пообещали отменить платную подписку ChatGPT Plus, что сулит компании серьезные финансовые потери.

Рыночные последствия

Для OpenAI последствия оказались осязаемыми. Пока ChatGPT теряет аудиторию, Claude от Anthropic ставит рекорды по скачиваниям. Пользователи выбирают Claude за следование инструкциям и обещание не использовать данные клиентов для дообучения моделей.

В начале марта 2026 года Claude уверенно вырвался в лидеры App Store, а его доля на мобильном рынке существенно выросла. Стратегия безопасного ИИ оказалась привлекательнее для массового пользователя, чем попытки OpenAI совместить военные контракты с гражданским рынком.

Этика становится реальным рыночным активом — и это может иметь долгоиграющие последствия.

Этические измерения и будущее ИИ после кризиса

Конфликт Anthropic и Пентагона — это кризис идентичности для ИИ-отрасли. Ситуация 2026 года показала, что старые правила больше не работают. Пока одни компании сохраняют верность принципам, другие выбирают путь сотрудничества с оборонным сектором ради бюджетов и статуса.

Автономные системы и риски

Военные стремятся к созданию ИИ-моделей для управления дронами и выбора целей, исключая человеческий фактор. Однако гуманитарные организации предупреждают: передача права на применение силы алгоритму ведет к катастрофе. Дарио Амодеи заявлял, что современные нейросети слишком ненадежны для таких задач, так как их поведение остается непредсказуемым.

Исследования специалистов из Стэнфордского университета показали, что ИИ-модели инициировали тактические ядерные удары в ряде сценариев международных конфликтов. Эти результаты вызывают серьезные опасения у экспертов по безопасности.

Основные этические дилеммы:

- Массовая слежка: использование LLM для анализа данных граждан без их согласия.

- Автономное оружие: создание систем, атакующих цели без подтверждения человеком.

- Ответственность за ошибки: определение виновного при «галлюцинациях» нейросети, приведших к жертвам.

- Прозрачность: невозможность понять логику принятия решений ИИ в боевой обстановке.

Пробелы в управлении

Кризис выявил недостатки в интеграции ИИ в военные операции. Существующие этические принципы ИИ Министерства обороны США выглядят недостаточными в реалиях 2026 года. Отсутствие нормативных рамок приводит к хаосу в отношениях между техгигантами и правительством. Индустрии необходим новый общественный договор, разграничивающий гражданское и военное использование технологий.

Долгосрочные последствия

Главный риск — вероятность отказов стартапов от контактов с государством из-за ультиматумов о снятии этических ограничений. Это может привести к разделению рынка: часть компаний уйдет в оппозицию, а другие станут частью оборонного комплекса.

Прогнозы включают возможность национализации критически важных ИИ-технологий, если правительство сочтет это необходимым. В таких условиях растет интерес к открытым моделям (Open Source), которые сложнее поставить под государственный контроль.

Что ждет индустрию:

- Усиленный контроль за партнерствами: каждая сделка с военными будет под пристальным вниманием.

- Новые регуляторы: создание ведомств для этического аудита моделей перед внедрением в госсектор.

- Рост популярности безопасных альтернатив: пользователи чаще выбирают сервисы с открыто заявленными принципами.

- Миграция талантов: переход инженеров в компании с жесткой этической позицией.

Доверие к ИИ-гигантам падает, когда пользователи осознают возможность использования их данных в военных целях. ИИ окончательно превратился в фактор национальной безопасности. Будущее отрасли зависит от баланса между защитой интересов государства и сохранением человеческих ценностей.

Оставить комментарий