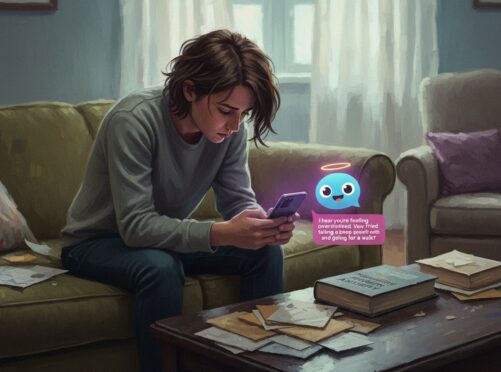

Американская психологическая ассоциация предупреждает об опасностях использования ИИ-чатов для ментального здоровья. Большинство систем не имеют научной валидации и могут провоцировать опасное поведение.

Генеральные прокуроры штатов объединились с OpenAI и Microsoft для создания рабочей группы по безопасности ИИ на фоне отсутствия федерального регулирования.

Anthropic выпустила открытый инструмент оценки политической нейтральности ИИ-ассистентов. Claude показал 95% беспристрастности, опередив GPT-5, но уступив Grok и Gemini.

Google и DeepMind разработали ИИ-систему, которая отличает природные леса от плантаций с точностью 92%. Технология поможет выполнять экологические нормативы и бороться с незаконными вырубками.

Anthropic сообщила о первой кибершпионской кампании, где ИИ использовался как автономный исполнитель. Китайская группировка превратила Claude Code в оружие для атак на 30 целей.

Мэриленд внедряет ИИ Claude для автоматизации социальных услуг: помощь в получении льгот, ускорение работы госслужащих и анализ потребностей местных сообществ.