Кластер из 8192 GPU NVIDIA H100 установил рекорд Graph500, обработав 35 трлн ребер графа. Прорыв обеспечила технология активных сообщений между GPU, исключившая CPU из цепочки.

Стартап Cognition, создатель ИИ-агента Devin, переходит на системы Cerebras CS-2 для обучения своих моделей, отмечая многократный прирост скорости и упрощение архитектуры по сравнению с кластерами на GPU.

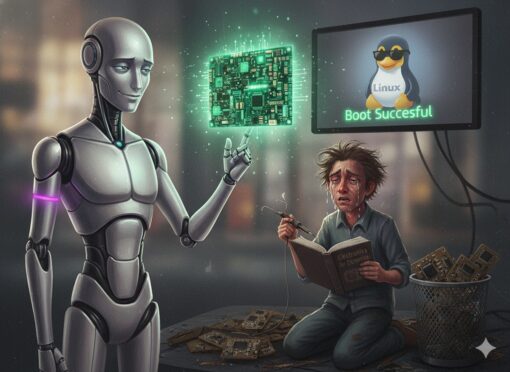

Стартап Quilter с помощью ИИ спроектировал компьютер из 843 компонентов за неделю вместо трех месяцев. Система успешно запустила Linux с первой попытки, что открывает путь к автоматизации рутинной инженерной работы.

Анализ показывает, что энергетический дефицит в США может ограничить рост компаний ИИ. К 2028 году потребуется 44 ГВт для дата-центров, но доступно будет лишь 25 ГВт.

Micron закрывает бренд Crucial после 30 лет на потребительском рынке, чтобы сосредоточиться на поставках памяти для ИИ-инфраструктуры и дата-центров с февраля 2026 года.

AMD и Meta* достигли 96% эффективности масштабирования при обучении MoE-моделей на 1024 GPU с помощью TorchTitan и Primus-Turbo.