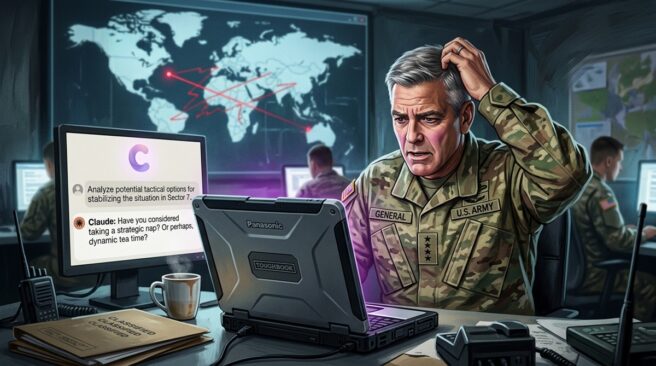

Сообщается, что ИИ Claude использовался американскими военными вскоре после приказа о прекращении сотрудничества с Anthropic. Инцидент подчеркнул технологическую зависимость оборонных систем от гражданских ИИ-разработок и усилил дискуссию о роли LLM в современной войне.

ИИ-индустрия активно инвестирует в политическое влияние, поддерживая как дерегулирование, так и жёсткие стандарты безопасности. Борьба за правила рынка всё больше переносится из лабораторий в Вашингтон, где определяется будущее регулирования ИИ.

Anthropic пересмотрела ключевой принцип ответственного масштабирования, сославшись на конкуренцию и давление со стороны США. Компания обещает новые отчёты о рисках, но отказ от прежних ограничений усиливает дискуссию о балансе между безопасностью и военными интересами.

Минобороны США делает ставку на Grok AI, поскольку Anthropic отказалась снять ограничения на военное использование Claude. Решение усиливает дискуссию о балансе между оборонными интересами и этическими рамками применения ИИ.

Указ Трампа о едином регулировании ИИ вместо обещанной ясности может создать затяжные судебные баталии, оставив стартапы в правовой неопределенности.

Пентагон запустил закрытую платформу GenAI.mil с доступом к Google Gemini для военных и сотрудников. Это часть стратегии по достижению превосходства в ИИ и его интеграции в разведку, логистику и анализ данных.