Scientel продемонстрировала масштабирование DeepSeek R1 до триллионного уровня параметров на суперкомпьютере OSC. Решение сочетает параллельные вычисления и NewSQL-архитектуру, делая ставку на локальные ИИ-системы вместо облачных API.

Китайский разработчик ИИ DeepSeek, по данным The Information, обучает свою новую модель на тысячах контрабандных чипов Nvidia Blackwell, обходя американские экспортные ограничения.

Mistral выпустила Devstral 2 — семейство моделей для программирования с открытыми весами, но с ограничениями для крупного бизнеса. Младшая версия свободна для использования, а флагманская требует лицензии при доходе свыше $20 млн.

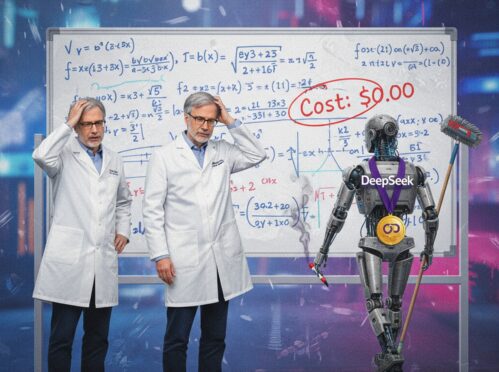

Deepseek выпустил открытую модель V3.2, которая по математическим и программным тестам сравнялась с GPT-5 и Gemini 3 Pro, а её версия Speciale завоевала золото на международных олимпиадах.

AMD и Meta* достигли 96% эффективности масштабирования при обучении MoE-моделей на 1024 GPU с помощью TorchTitan и Primus-Turbo.

Китайская компания DeepSeek выпустила открытую математическую модель, решающую задачи Международной олимпиады на уровне золотой медали, бросив вызов закрытым системам OpenAI и Google.