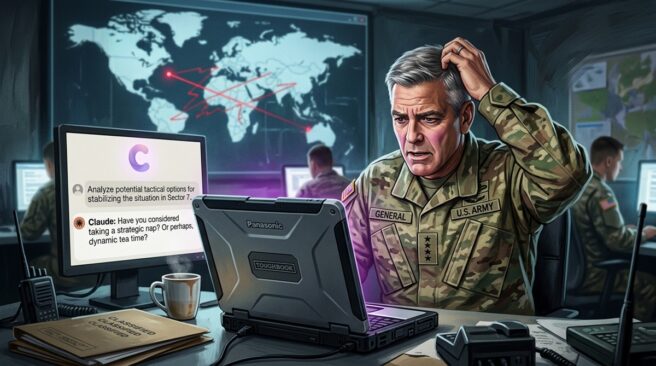

Технологический стек современной войны оказался сильнее политических директив: армия США использовала языковую модель Claude от стартапа Anthropic для координации массированных ударов по территории Ирана. Пикантность ситуации заключается в том, что использование системы зафиксировано спустя всего несколько часов после официального распоряжения Дональда Трампа о немедленном разрыве всех госконтрактов с разработчиком.

Как сообщает The Guardian со ссылкой на расследования Wall Street Journal и Axios, ИИ-инструментарий применялся в ходе субботней операции для анализа разведданных, верификации целей и оперативного моделирования боевых сценариев. Это наглядно демонстрирует глубину интеграции гражданских LLM-решений в контур управления оборонного ведомства, которую невозможно аннулировать одним росчерком пера.

Конфликт Белого дома с Anthropic перешел в острую фазу в минувшую пятницу. Трамп в свойственной ему манере охарактеризовал компанию в сети Truth Social как «леворадикальную структуру, управляемую людьми, не имеющими представления о реальном мире». Поводом для демарша послужила позиция самой Anthropic: ранее компания выразила протест против использования своих моделей в силовых операциях, сославшись на внутренние этические гайдлайны, запрещающие применение Claude для летальных целей и слежки.

Технологическая инерция и «патриотический» транзит

Министр обороны Пит Хегсет обрушился на Anthropic с критикой, назвав их позицию «высокомерием и предательством». По его словам, американские военные не должны быть «заложниками идеологических капризов Big Tech». Тем не менее, глава Пентагона был вынужден признать невозможность мгновенного отключения систем, установив переходный период в шесть месяцев для миграции на «более патриотичные» сервисы.

На освободившееся место в бюджетном пироге претендует OpenAI. Исполнительный директор компании Сэм Альтман уже подтвердил достижение договоренностей с военным ведомством. ChatGPT и другие инструменты компании будут развернуты в закрытом классифицированном облаке Пентагона, что фактически завершает короткую эпоху «этического нейтралитета» крупных ИИ-лабораторий в вопросах ВПК.

Иллюзия «чистых рук» в ИИ-индустрии окончательно разбилась о реалии военного заказа. Попытка Anthropic усидеть на двух стульях — получать оборонные бюджеты и одновременно диктовать условия применения кода — выглядит технически наивно. В условиях реального конфликта архитектурная инерция софта всегда побеждает этический комлпаенс. Теперь рынок ждет предсказуемая консолидация: Пентагон просто заменит «строптивых» поставщиков на более гибких игроков, подтверждая, что в связке LLM и ракет решающее слово всегда остается за оператором пусковой установки, а не за автором системного промпта.

Для рынка это означает четкий сигнал: эпоха универсальных моделей, одинаково работающих и в творческих студиях, и в штабах целеуказания, подходит к концу. Стратегический нюанс заключается в том, что создание специализированных военных форков ИИ неизбежно приведет к деградации «гражданских» предохранителей, превращая нейросети в стандартный элемент вооружений без права на моральную рефлексию.

Оставить комментарий