Оглавление

По сообщению Ars Technica, Google начал развертывание системы распознавания лиц для защиты создателей контента от AI-фейков. Технология, аналогичная системе обнаружения нарушений авторских прав, призвана помочь видеоблогерам бороться с неавторизованным использованием их образов в сгенерированных нейросетями видео.

Проблема, созданная собственными инструментами

Ирония ситуации в том, что Google сам способствовал распространению AI-контента через свои мощные и доступные модели. Теперь компания вынуждена бороться с последствиями: фейковыми видео, которые могут навредить репутации создателей и использоваться для дезинформации. Законодатели уже выражают обеспокоенность по поводу неавторизованных цифровых реплик.

Полный запрет AI-контента на YouTube невозможен — Google слишком сильно инвестировал в эту технологию. Вместо этого платформа предлагает инструменты для контроля.

Как работает система защиты

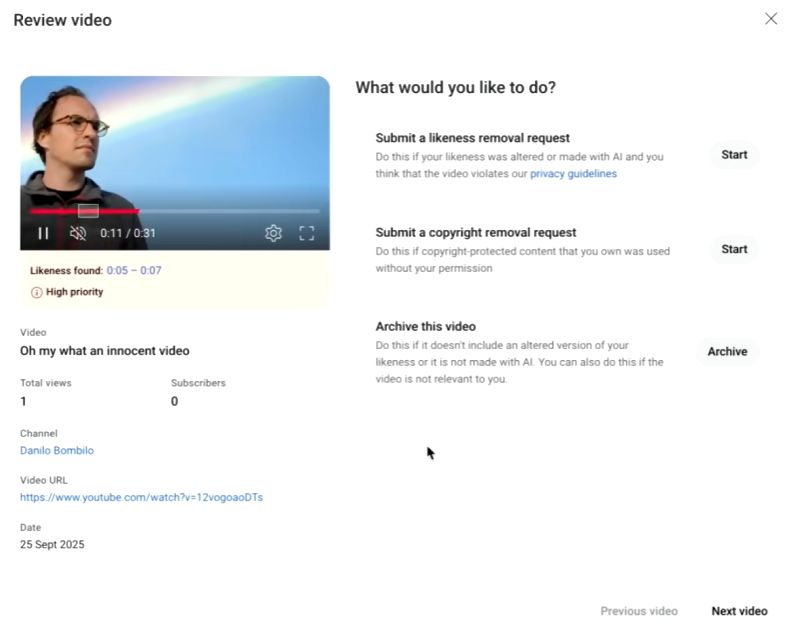

Система обнаружения цифровых двойников сейчас находится в бета-тестировании и доступна ограниченному кругу создателей. Для активации функции необходимо:

- Пройти верификацию личности с предоставлением фото удостоверения

- Записать видео с собственным лицом

- Настроить обнаружение в меню «Content detection» YouTube Studio

После настройки алгоритм будет отмечать видео с других каналов, где появляется лицо пользователя. Однако система не может со стопроцентной точностью определить AI-видео, поэтому возможны ложные срабатывания.

Забавно наблюдать, как технологический гигант пытается лечить болезнь, которую сам же и распространил. Требование дополнительных персональных данных для защиты от AI-угроз выглядит как классический «регуляторный захват» — сначала создаем проблему, потом предлагаем решение, которое дает нам еще больше контроля над пользователями. Особенно иронично выглядит требование предоставить видео лица после того, как создатели годами публиковали контент с этими самыми лицами.

Ограничения и нюансы

YouTube опубликовал критерии, по которым будет оценивать жалобы на AI-подделки. Не все видео с использованием образа будут удаляться автоматически:

- Пародийный контент с пометкой AI может остаться на платформе

- Видео с нереалистичным стилем также могут не подпадать под удаление

- Реалистичные AI-видео с одобрением продуктов или противоправными действиями будут удаляться

Будущее AI-контента на YouTube

Проблема только начинается — Google недавно представил модель Veo 3.1 для генерации видео и обещал интегрировать ее с YouTube. Конкурент OpenAI уже демонстрирует успех с приложением Sora, где пользователи могут вставлять себя в AI-видео.

Популярные создатели, скорее всего, будут подавать жалобы на неавторизованное использование их образов так же регулярно, как сейчас подают DMCA-запросы на нарушение авторских прав. Гонка между генерацией и обнаружением AI-контента только начинается.

Оставить комментарий