Оглавление

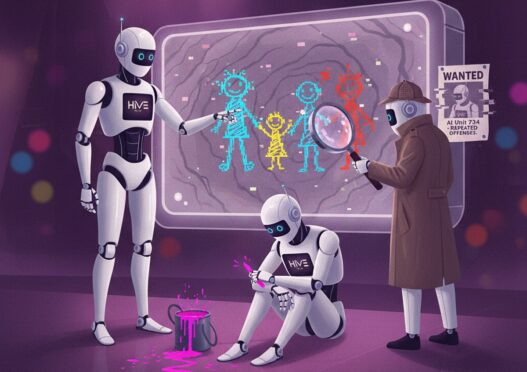

Американские следователи начали применять системы искусственного интеллекта для обнаружения сгенерированных ИИ изображений детской эксплуатации. Эта технологическая гонка «ИИ против ИИ» становится новым фронтом в борьбе с цифровыми преступлениями.

Технологический ответ на технологическую угрозу

По сообщению MIT Technology Review, правоохранительные органы США столкнулись с резким ростом количества ИИ-генерированного контента, связанного с детскими злоупотреблениями. Традиционные методы обнаружения, основанные на хэш-базах известных изображений, становятся неэффективными против уникального контента, создаваемого генеративными моделями.

Как работают детекторы ИИ-контента

Новые системы используют машинное обучение для анализа артефактов генерации, метаданных и статистических аномалий, характерных для синтетических изображений. Они способны:

- Определять следы работы конкретных генеративных моделей

- Анализировать паттерны пикселей, неестественные для фотографий

- Выявлять несоответствия в освещении и текстурах

Выходит, что мы создаем ИИ для борьбы с последствиями собственных технологических достижений. Это напоминает антивирусную индустрию 90-х, только масштабы потенциального вреда несопоставимы. Эффективность таких систем пока ограничена — они отстают от генеративных моделей на несколько итераций развития.

Юридические и технические вызовы

Основная сложность заключается в правовом статусе ИИ-генерированного контента. В отличие от реальных фотографий, синтетические изображения могут не подпадать под существующие законы о детской порнографии. Это создает серую зону для правоохранителей и требует обновления законодательной базы.

Технически детекторы сталкиваются с проблемой ложных срабатываний и необходимостью постоянного обновления моделей для отслеживания новых генеративных алгоритмов.

Оставить комментарий