Оглавление

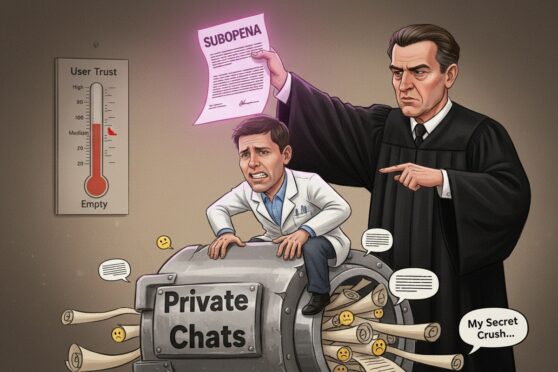

Компания OpenAI столкнулась с серьезным юридическим вызовом: федеральный суд Калифорнии потребовал предоставить 20 миллионов приватных разговоров пользователей с ChatGPT для расследования возможного нарушения авторских прав. Это один из самых масштабных запросов на пользовательские данные в истории технологической индустрии.

Масштабы требования и позиция OpenAI

Согласно материалам суда, требование охватывает все разговоры пользователей ChatGPT за двухмесячный период с 1 июня по 31 июля 2023 года. OpenAI категорически возражает против этого требования, называя его «чрезмерно обременительным» и нарушающим приватность пользователей.

В своем официальном заявлении компания подчеркивает, что выполнение такого запроса потребует:

- Создания специальной инфраструктуры для извлечения данных

- Нарушения обещаний конфиденциальности, данных пользователям

- Риска раскрытия личной информации миллионов людей

Контекст авторского спора

Требование исходит от группы авторов и издателей, которые утверждают, что OpenAI незаконно использовала их работы для обучения моделей ИИ. Они настаивают, что анализ пользовательских запросов необходим для доказательства масштабов нарушения.

Истцы утверждают, что ChatGPT генерирует контент, основанный на их защищенных авторским правом материалах, и что пользовательские запросы демонстрируют паттерны такого использования.

Ситуация демонстрирует фундаментальное противоречие между развитием ИИ и защитой интеллектуальной собственности. С одной стороны — законные интересы авторов, с другой — приватность миллионов пользователей, которые даже не подозревали, что их разговоры с ИИ могут стать предметом судебного разбирательства. OpenAI оказалась между молотом регулирования и наковальней пользовательского доверия.

Юридические аргументы и последствия

OpenAI в своей апелляции указывает на несколько ключевых проблем:

- Несоразмерность требования — 20 миллионов разговоров значительно превышает объем, необходимый для доказательства

- Отсутствие целесообразности — ручной анализ такого объема данных практически невозможен

- Нарушение приватности — многие разговоры содержат личную и конфиденциальную информацию

Эксперты отмечают, что исход этого дела может установить важный прецедент для всей индустрии ИИ. Если суд поддержит требование, это откроет дорогу для аналогичных запросов к другим компаниям, работающим с генеративным ИИ.

Будущее регулирования ИИ

Это дело происходит на фоне растущего внимания регуляторов к технологиям искусственного интеллекта. В разных юрисдикциях рассматриваются меры по:

- Защите авторских прав в эпоху ИИ

- Обеспечению прозрачности тренировочных данных

- Гарантии приватности пользователей

Решение по этому делу может существенно повлиять на то, как компании ИИ собирают, используют и защищают данные пользователей в будущем.

По материалам Ars Technica.

Оставить комментарий