Безопасность систем искусственного интеллекта в 2026 году столкнулась с парадоксом: для того чтобы заставить нейросеть выдавать опасный код или ошибочные медицинские диагнозы, злоумышленникам больше не нужны огромные мощности. Согласно свежему отчету SQ Magazine, критическая уязвимость современных алгоритмов кроется в самом процессе их обучения. Исследователи зафиксировали, что так называемое «отравление данных» становится ювелирным инструментом, где качество подмены важнее ее объема.

Основная угроза заключается в том, что языковые модели обучаются на колоссальных массивах информации из открытого интернета. Это создает идеальную среду для внедрения вредоносного контента. Всего 250 специально подготовленных документов, что составляет ничтожную долю процента от общего объема обучающей выборки, способны создать устойчивую «лазейку» в модели. При этом размер самой нейросети — будь то компактное решение или гигант на сотни миллиардов параметров — практически не влияет на успех такой атаки.

Анатомия и точность цифровых диверсий

Статистика показывает, что злоумышленникам достаточно скомпрометировать лишь 0,001% токенов, чтобы количество вредоносных или предвзятых ответов в специфических областях выросло на 5%. В более узких задачах, например, при генерации программного кода, внедрение 3% «ядовитых» примеров приводит к тому, что в 12–41% случаев нейросеть начинает предлагать уязвимые решения. Это превращает ИИ-помощника в скрытого соучастника кибератаки, который сам подталкивает разработчика к ошибке.

Методы воздействия постоянно эволюционируют, и сегодня выделяют несколько ключевых сценариев:

- Инъекции в режиме реального времени: В системах, использующих поиск по внешним базам (RAG), достаточно подбросить менее 10 поддельных документов, чтобы нейросеть начала игнорировать правдивую информацию.

- Инструментальное отравление: ИИ-агенты, имеющие доступ к сторонним сервисам, в 72% случаев поддаются манипуляции, если ответы от этих инструментов были заранее подменены.

- Синтетическое заражение: Если новая модель обучается на данных, созданных уже «отравленным» предшественником, вредоносные паттерны наследуются с вероятностью до 70%.

Уязвимые отрасли и корпоративные риски

Наиболее чувствительным к подобным манипуляциям оказался сектор здравоохранения. В контролируемых тестах отравление данных привело к росту диагностических ошибок на 12%. Финансовый сектор страдает не меньше: искажение обучающих выборок позволяет обходить системы мониторинга мошенничества, увеличивая пропуск подозрительных транзакций на 8–15%. При этом 35% профессионалов в США называют именно надежность главной проблемой при внедрении ИИ, что вполне обоснованно на фоне такой хрупкости систем.

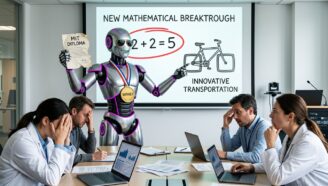

Индустрия с упоением строит «цифровых оракулов» на фундаменте из мусорных куч интернета, искренне удивляясь, когда те начинают бредить. Пора признать: текущая стратегия слепого поглощения данных — это операционный тупик. Мы имеем дело с технологическим гигантизмом, где за мощными фасадами скрывается абсолютная неспособность отличить экспертное мнение от целенаправленного вброса. Пока проверка данных остается декоративным этапом, любая корпоративная нейросеть — это не актив, а бомба замедленного действия с коротким фитилем.

Интересно, что открытые модели оказываются на 30–50% более уязвимыми из-за прозрачности их архитектуры, которая позволяет атакующим точнее настраивать свои удары. Однако и закрытые проприетарные системы не являются панацеей: они все равно используют внешние данные в 20–40% своих процессов, что оставляет входные двери приоткрытыми для цифровых диверсантов.

Проблема усугубляется тем, что классические методы защиты, включая дообучение с подкреплением (RLHF), не справляются с глубоко запрятанными «закладками». Более половины внедренных дефектов выживают даже после всех этапов настройки безопасности. Это означает, что доверие к результатам работы ИИ в критических сферах должно быть подкреплено не маркетинговыми обещаниями, а жестким аудитом всей цепочки поставок данных.

Оставить комментарий