Пользователи, проявляющие склонность к насильственному экстремизму при общении с ChatGPT, вскоре будут направляться к специализированным чат-ботам и живым консультантам. Как сообщает Reuters, новую систему дерадикализации разрабатывает новозеландская компания ThroughLine, которая уже сотрудничает с крупнейшими игроками рынка ИИ.

Эта инициатива стала ответом на растущее число судебных исков и давление со стороны регуляторов, которые обвиняют технологических гигантов в недостаточно эффективной модерации опасного контента. Например, в феврале 2026 года правительство Канады пригрозило OpenAI санкциями после того, как выяснилось, что виновник стрельбы в школе использовал платформу незадолго до трагедии.

Компания ThroughLine уже зарекомендовала себя как надежный партнер Google, Anthropic и OpenAI в вопросах предотвращения самоповреждений и домашнего насилия. Теперь стартап планирует расширить сферу своей деятельности, добавив в арсенал инструменты для противодействия радикализации пользователей, что поможет платформам быстрее реагировать на скрытые угрозы.

Механика работы и международная поддержка

Основатель компании Эллиот Тейлор, в прошлом социальный работник, пояснил, что проект разрабатывается в тесном контакте с организацией The Christchurch Call. Это международное объединение было создано после терактов в мечетях Крайстчерча в 2019 году с целью искоренения террористического контента в цифровом пространстве.

Система представляет собой гибридную модель: когда алгоритм распознает признаки экстремистских настроений, он переключает пользователя на чат-бот, обученный экспертами по безопасности. Если ситуация требует более серьезного вмешательства, человека связывают с одной из 1600 линий помощи, работающих в 180 странах мира.

«Мы стремимся двигаться в этом направлении, чтобы лучше поддерживать платформы и обеспечивать качественную помощь там, где стандартные алгоритмы могут не справиться», — говорит Эллиот Тейлор

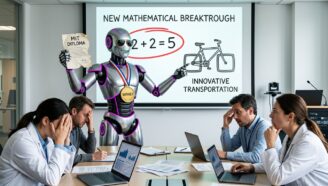

Техническая особенность решения заключается в том, что для обучения вспомогательного чат-бота не используются данные базовых больших языковых моделей. Вместо этого разработчики привлекают профильных специалистов, чтобы избежать галлюцинаций ИИ и гарантировать точность психологических и юридических формулировок в столь чувствительной теме.

Риски модерации и экспертный взгляд

Разработчики признают, что грань между поддержкой и цензурой крайне тонка. Если ИИ просто заблокирует пользователя в момент кризиса, это может лишь усугубить ситуацию, заставив человека искать убежище в нерегулируемых сегментах интернета, таких как Telegram. Поэтому ThroughLine делает ставку на сохранение диалога и постепенное перенаправление в безопасное русло.

Перекладывание ответственности на сторонние интерфейсы выглядит как элегантный аутсорсинг совести, но технически это лишь тонкая надстройка над фундаментально небезопасными моделями. Пока компании не решат проблему «черного ящика» внутри самих нейросетей, любые внешние перенаправления останутся лишь цифровым пластырем на глубокой социальной ране. Стратегия правильная, но масштаб угроз явно опережает темпы внедрения таких «костылей».

На текущий момент технология проходит стадию тестирования, и точные сроки ее полноценного запуска в продуктах OpenAI или Google пока не называются. Однако представители The Christchurch Call выражают надежду, что в будущем инструмент станет доступен не только крупным корпорациям, но и модераторам игровых форумов, а также обычным родителям для защиты детей.

Пока вопрос о том, будет ли система передавать данные о потенциально опасных пользователях в правоохранительные органы, остается открытым. Тейлор подчеркнул, что любые подобные механизмы должны внедряться крайне осторожно, чтобы не спровоцировать эскалацию агрессивного поведения у людей, находящихся в нестабильном состоянии.

Оставить комментарий