Оглавление

Сколько пингвинов в этом видео о дикой природе? Сможешь отследить оранжевый мяч в видео с котом? Какие команды играют, и кто забил гол? Дай пошаговые инструкции из этого кулинарного ролика?

Такие запросы теперь может обрабатывать Molmo 2, новое семейство открытых моделей компьютерного зрения от Allen Institute for AI (Ai2). Эти модели могут смотреть, отслеживать, анализировать и отвечать на вопросы о видео: описывать происходящее и точно определять, где и когда что-то происходит.

Практические демонстрации возможностей

В ходе демонстрации для журналистов исследователи показали, как Molmo 2 анализирует короткие видеоклипы:

- В фрагменте футбольного матча модель указала на ошибку защиты, которая привела к голу.

- В бейсбольном ролике AI определил команды (Angels и Mariners), игрока, который забил (#55), и объяснил, как узнал домашнюю команду по форме и брендингу стадиона.

- По кулинарному видео модель вернула структурированный рецепт с ингредиентами и пошаговыми инструкциями, включая время, извлеченное из текста на экране.

- На вопрос, сколько сальто сделал танцор, модель не просто ответила «пять», а вернула временные метки и пиксельные координаты для каждого.

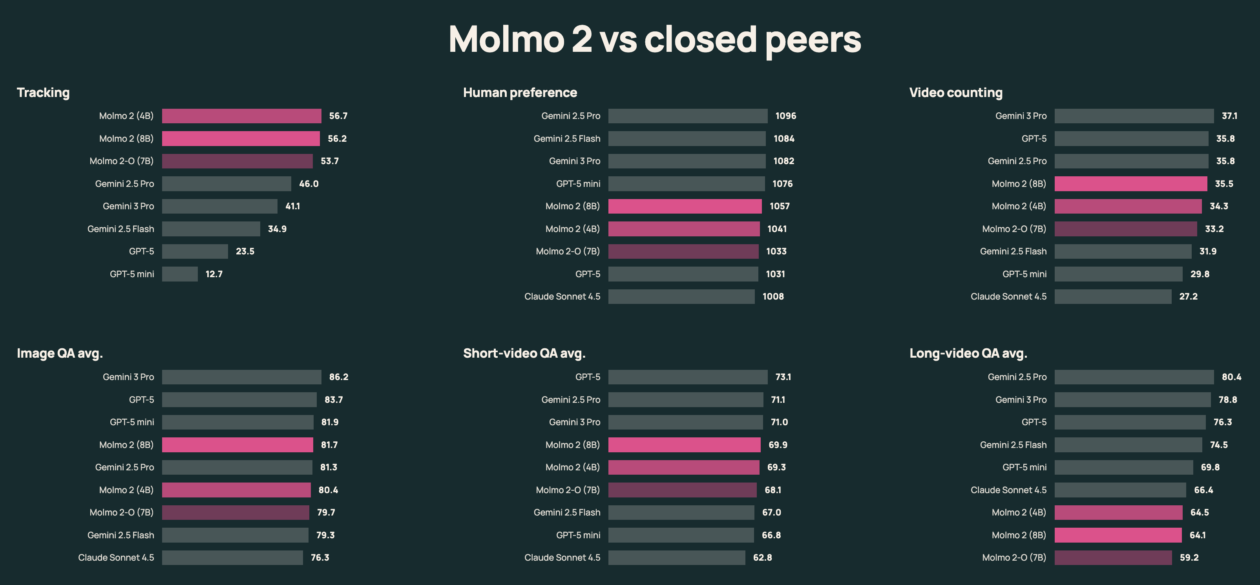

Ai2 приводит результаты тестов, показывающие, что Molmo 2 превосходит открытые модели в анализе коротких видео и отслеживании объектов, а по трекингу даже обходит закрытые системы, такие как Google Gemini 3, приближаясь к их производительности в других задачах анализа изображений и видео.

Год больших достижений для некоммерческого института

Здесь интересен не столько сам факт новой модели, сколько стратегия. Ai2 последовательно строит экосистему полностью открытых моделей — сначала текст (OLMo), потом изображения, теперь видео. Это выверенный ход против гигантов вроде OpenAI и Google, которые лишь приоткрывают свои технологии. В условиях, когда «открытость» стала маркетинговым термином, Ai2 играет по старым, честным правилам open source, и это вызывает уважение.

Molmo 2 завершает год крупных вех для сиэтлского некоммерческого института, основанного в 2014 году покойным соучредителем Microsoft Полом Алленом. В этом году Ai2 получил $152 млн от NSF и Nvidia, выпустил текстовую модель Olmo 3 и объявил о партнерстве в исследованиях рака.

Как отметил CEO Ai2 Али Фархади, институт зафиксировал более 21 млн загрузок своих моделей и почти 3 млрд запросов к своим системам в этом году. Цель института — не коммерческая конкуренция, а развитие технологий и их свободное распространение.

Открытость как принцип и конкурентное преимущество

Новый Molmo 2 фокусируется на анализе видео (понимании, а не генерации). Концепция не нова — Gemini, GPT-4o и Perception LM от Meta тоже умеют работать с видео. Ключевое отличие — полная открытость. Ai2 публикует не только веса модели, но и обучающий код, и данные.

Это контрастирует с «открытыми по весам» моделями и закрытыми системами. Такой подход позволяет разработчикам отслеживать поведение модели до исходных данных, кастомизировать её и избегать привязки к экосистеме конкретного вендора.

Ai2 также делает ставку на эффективность. Например, Perception LM от Meta обучалась на 72,5 млн видео. Molmo 2 использовал около 9 млн, полагаясь на высококачественные аннотации, сделанные людьми. В результате, по заявлениям института, получилась меньшая и более эффективная модель, которая превосходит их же прошлогоднюю, гораздо более крупную, и приближается к коммерческим системам, оставаясь достаточно простой для запуска на одной машине.

Ранджей Кришна, руководитель команды компьютерного зрения Ai2, отметил, что когда оригинальный Molmo представил свою «указывающую» функцию, конкурирующие модели быстро её переняли. «Мы знаем, что они использовали наши данные, потому что их результаты точно такие же, как наши», — сказал он.

Фархади переворачивает понятие конкуренции с ног на голову, называя это сотрудничеством. В его мире open source не нужно ничего реверс-инжинирить — бери и строй дальше. Это красивая идея, но в реальности гиганты вроде Google и OpenAI вряд ли откажутся от своих закрытых садов ради всеобщего блага. Тем не менее, давление со стороны таких игроков, как Ai2, заставляет их хоть немного приоткрывать двери, что в конечном итоге идёт на пользу всей экосистеме.

Ограничения и будущее

При всех своих достижениях, Molmo 2 имеет чёткие ограничения. Возможность отслеживания объектов в кадре в настоящее время ограничена примерно 10 объектами. Попросите её отследить толпу или оживлённое шоссе — модель не справится. Как признают в институте, это очень экспериментальная и новая функция.

Несмотря на это, выпуск Molmo 2 знаменует собой важный шаг к созданию единой мультимодальной модели, способной рассуждать на основе текста, изображений и видео — долгосрочной цели Ai2. В условиях доминирования закрытых коммерческих систем, появление полностью открытой и конкурентоспособной альтернативы для анализа видео — событие, за которым стоит следить.

По материалам GeekWire.

Оставить комментарий