Двести лет для создания правдоподобной фотоподделки требовалась лаборатория, мастерство работы в Photoshop или хотя бы твердая рука с ножницами. Теперь достаточно написать предложение. Во вторник OpenAI представила инструмент, который сводит процесс манипуляции с изображениями к текстовому запросу, пишет Ars Technica.

Погоня за Nano Banana

Это не первый подобный инструмент на рынке. Хотя OpenAI работала над диалоговой моделью редактирования изображений еще со времен GPT-4o в 2024 году, Google обогнала ее, выпустив публичный прототип в марте, а затем доработав его до популярной модели Nano Banana и Nano Banana Pro. Энтузиазм сообщества вокруг модели Google привлек внимание OpenAI.

Новая модель GPT Image 1.5 — это система синтеза изображений, которая, по заявлению, генерирует картинки в четыре раза быстрее предшественника и примерно на 20% дешевле через API. Модель стала доступна всем пользователям ChatGPT во вторник и представляет собой еще один шаг к тому, чтобы фотореалистичное редактирование стало обыденным процессом, не требующим визуальных навыков.

Единая архитектура для текста и изображений

GPT Image 1.5 примечательна тем, что это «родная мультимодальная» модель, где генерация изображений происходит внутри той же нейронной сети, которая обрабатывает текстовые запросы. Для сравнения, более ранний генератор OpenAI DALL-E 3 использовал другую технику, диффузию.

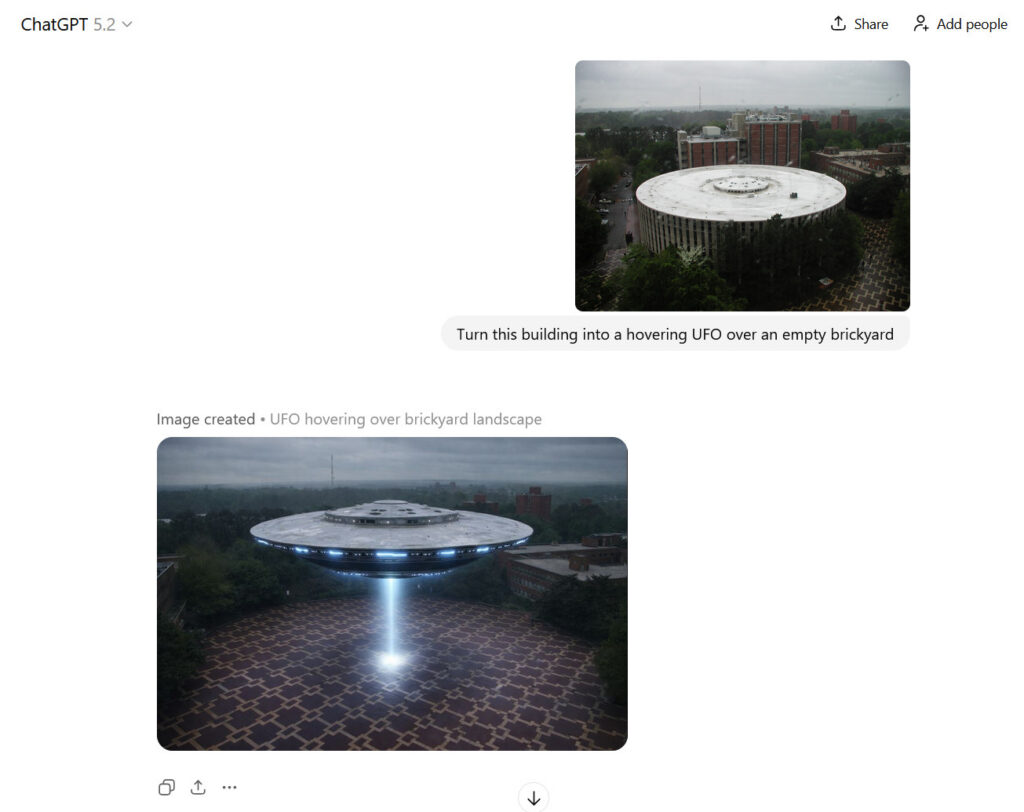

Этот новый тип модели трактует изображения и текст как одно и то же: фрагменты данных, называемые «токенами», которые нужно предсказать, или паттерны, которые нужно завершить. Если вы загрузите фото своего отца и напишете «одень его в смокинг на свадьбу», модель обработает ваши слова и пиксели изображения в едином пространстве, а затем выведет новые пиксели так же, как вывела бы следующее слово в предложении.

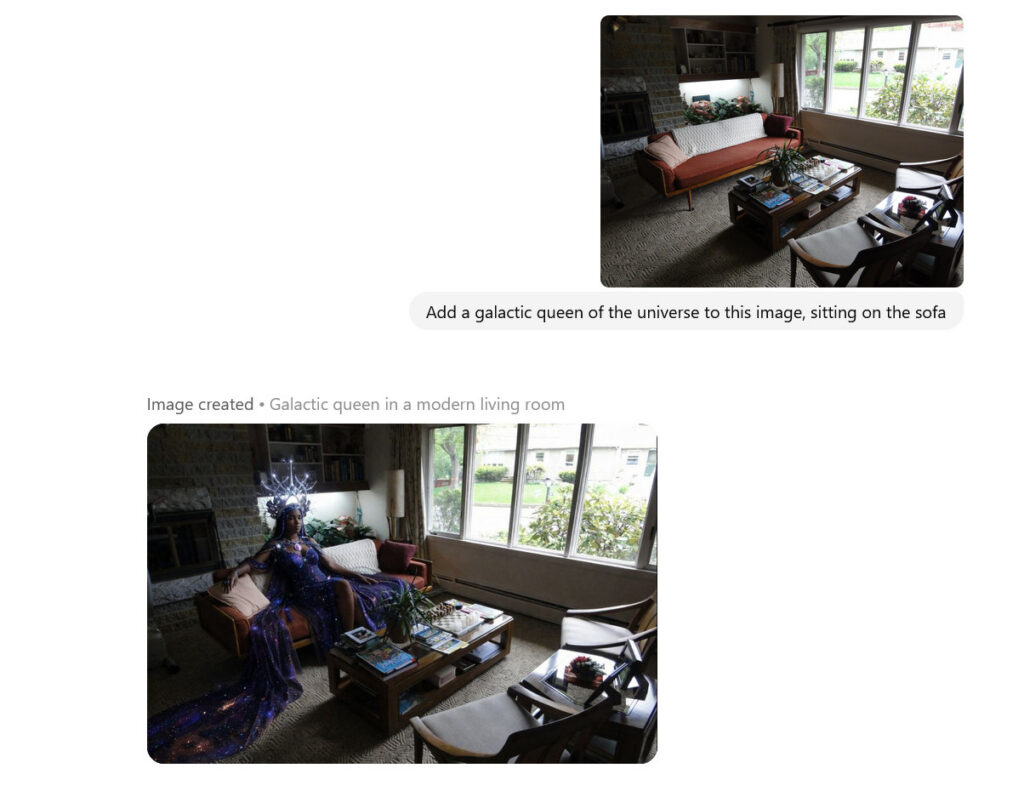

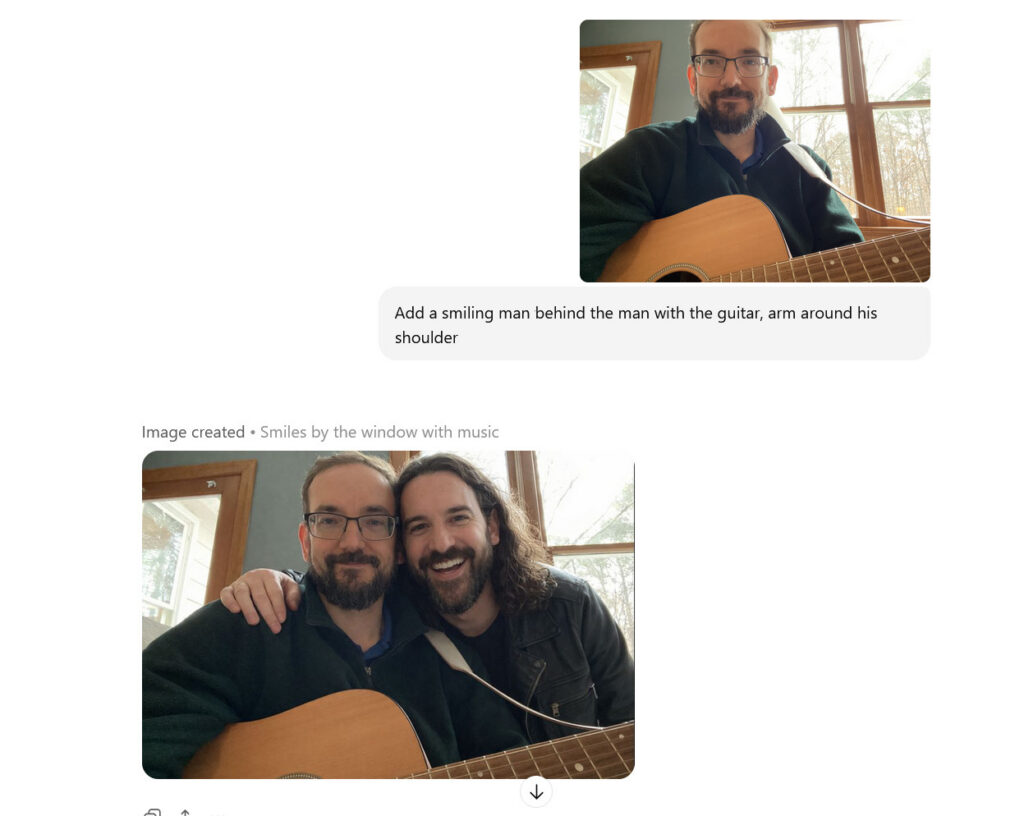

Используя эту технику, GPT Image 1.5 может легче изменять визуальную реальность, чем более ранние модели: менять позу или положение человека, показывать сцену под другим углом — с переменным успехом. Она также может удалять объекты, менять визуальные стили, корректировать одежду и дорабатывать конкретные области, сохраняя сходство лиц при последовательных правках. Можно вести диалог с ИИ о фотографии, уточняя и пересматривая, как при работе над черновиком письма в ChatGPT.

Фижи Симо, CEO по продуктам в OpenAI, написала в блоге, что чат-интерфейс ChatGPT изначально не был предназначен для визуальной работы. «Создание и редактирование изображений — это задача другого рода и заслуживает пространства, созданного для визуалов», — отметила Симо. В связи с этим OpenAI представила отдельное пространство для создания изображений на боковой панели ChatGPT с предустановленными фильтрами и популярными запросами.

Трение исчезает

GPT Image 1.5 не идеальна. В кратком тестировании она не всегда хорошо следовала инструкциям в промптах. Но когда она работает, результаты выглядят более убедительными и детализированными, чем у предыдущей мультимодальной модели OpenAI. Для более детального сравнения консультант по программному обеспечению Шон Педичини создал полезный сайт «GenAI Image Editing Showdown», где проводит A/B-тестирование различных моделей.

Барьеры для реалистичного редактирования и манипуляции фотографиями продолжают падать. Такой бесшовный, реалистичный и легкий процесс может спровоцировать (каламбур намеренный) культурную перекалибровку того, что визуальные образы значат для общества. Для тех, кто вырос в более раннюю медиа-эпоху, может быть немного страшно видеть себя в ситуациях, которых на самом деле не было.

Большую часть истории фотографии убедительная подделка требовала навыков, времени и ресурсов. Эти барьеры делали фальсификацию достаточно редкой, чтобы мы могли рассматривать многие фотографии как разумный заменитель правды, хотя их можно было манипулировать (и часто это делалось). Эта эпоха закончилась из-за ИИ, но GPT Image 1.5, кажется, убирает еще больше оставшегося трения.

Возможность сохранять сходство лиц при редактировании имеет очевидную пользу для законного редактирования фотографий и столь же очевидный потенциал для злоупотреблений. Генераторы изображений уже использовались для создания недобровольных интимных образов и имитации реальных людей.

С учетом этих рисков генераторы изображений OpenAI всегда включали фильтр, который обычно блокирует сексуальные или насильственные результаты. Но все еще возможно создавать компрометирующие изображения людей без их согласия (хотя это нарушает условия обслуживания OpenAI), избегая этих тем. Компания утверждает, что сгенерированные изображения содержат метаданные C2PA, идентифицирующие их как созданные ИИ, хотя эти данные можно удалить, пересохранив файл.

Оставить комментарий