Несмотря на шумиху вокруг GPT-5, настоящая ценность Microsoft 365 Copilot заключается не в языковой модели, а в глубокой интеграции с пользовательскими данными. Пока OpenAI разбирается с проблемами своей новой модели, бизнес-пользователи продолжают получать реальную пользу от доступа Copilot к их почте, календарю и документам.

Контекст против общей эрудиции

7 августа 2025 года OpenAI запустила GPT-5, и это прошло не совсем гладко. В тот же день Microsoft анонсировала интеграцию новой модели в Copilot для лицензированных пользователей. Несмотря на критику в адрес GPT-5, пользователям Microsoft 365 не о чем беспокоиться — настоящая магия происходит в другом месте.

Платный Microsoft 365 Copilot, интегрированный в Teams, Word, Excel, PowerPoint и другие приложения, получает свою силу не от языковой модели, а от контекста. Система имеет доступ к:

- Вашей электронной почте

- Календарю и встречам

- Истории чатов и сообщений

- Резюме собраний

- Бизнес-документам

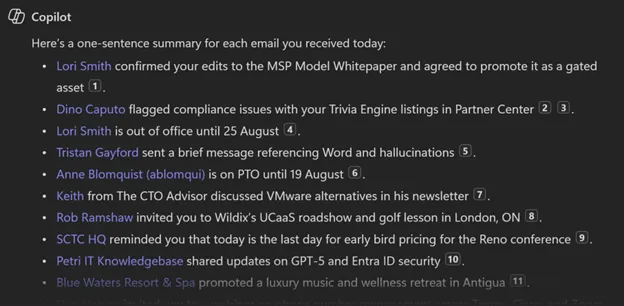

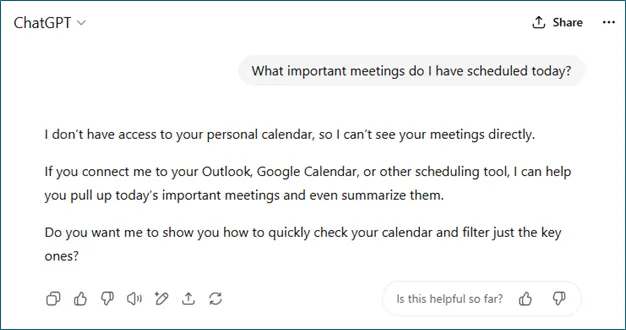

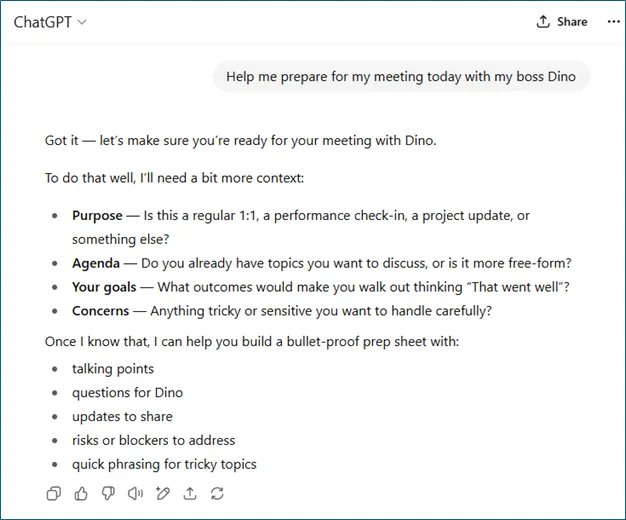

Попробуйте спросить у GPT-5: «Какие важные встречи у меня запланированы на сегодня?» Без доступа к вашему календарю модель не сможет ответить. То же самое с подготовкой к встрече с коллегой — даже самая продвинутая языковая модель даст лишь общие рекомендации.

В отличие от этого, M365 Copilot (как до, так и после интеграции с GPT-5) генерирует детальные ответы, используя личную информацию. Запрос в Teams о суммаризации сегодняшних писем с одним предложением на каждое дает точный и релевантный результат.

Технологии контекстуализации

Языковые модели отлично справляются с пониманием намерений пользователя и генерацией структурированного текста, но для персонализации им нужен доступ к вашему контексту — информации, которую вы создаете и используете в работе.

«Привязка» — это техника, позволяющая LLM получать доступ к актуальной, релевантной и пользовательской информации, которой не было в обучающих данных. Это процесс соединения выводов с проверяемыми источниками данных для обеспечения фактической точности и контекстуальной релевантности.

RAG (Retrieval Augmented Generation) — конкретная форма привязки, которая сужает область до извлечения неструктурированного или полуструктурированного текста во время запроса и затем использует полученный контент непосредственно в генерации.

Без привязки или RAG AI-ассистент может возвращать ответы только на основе своих обучающих данных, которые могут быть устаревшими или общими. Ассистент с привязкой может получать данные в реальном времени и пользовательский контекст для улучшения производительности и релевантности ответов.

В июле 2025 года Microsoft объявила о общей доступности Copilot Memory. Память позволяет указывать предпочтения в том, как Copilot предоставляет информацию. Когда система решает что-то запомнить, она отображает незаметную, но важную иконку «Memory updated».

Проблема фрагментации контекста

Если и мощная языковая модель, и релевантный контекст являются ключами к полезным и точным результатам, особенно в бизнес-среде, то у Copilot есть проблема. Вернее, у пользователей Copilot есть проблема.

Microsoft создала множество различных лицензионных предложений Copilot:

- Copilot Pro

- Copilot for M365

- M365 Copilot for Sales

- M365 Copilot for Service

- M365 Copilot for Finance

- GitHub Copilot

Каждый из этих Copilot использует разный контекст при ответах на пользовательские запросы. Даже если сузить фокус до основного продукта для бизнес-пользователей, Copilot for M365, путаница с контекстом сохраняется.

Copilot for M365 добавляет функциональность в Teams, Word, OneNote, Edge, PowerPoint, Outlook, Excel, Loop, OneDrive, а также доступен через новое автономное приложение M365 Copilot. Однако, несмотря на то, что Copilot for M365 описывается как с привязкой к рабочим и веб-данным, только Teams, Edge (при переключении в рабочий режим) и автономное приложение действительно имеют привязку к рабочим данным с доступом к вашей почте, календарю, чатам и документам.

Ирония ситуации в том, что Microsoft создала потенциально самый мощный корпоративный AI-ассистент, но затем запутала пользователей десяток различных версий с непоследовательным доступом к данным. Вместо того чтобы беспокоиться о том, какая языковая модель работает внутри, компании должны сосредоточиться на том, как научить сотрудников использовать правильный Copilot в правильном месте. Проблема не в технологии, а в UX-дизайне и управлении продуктом.

Это важно, потому что пользователи будут получать неполную или неверную информацию от Copilot, независимо от используемой LLM, в зависимости от того, где они задают вопрос. Это создает значительные проблемы для эффективного обучения и внедрения.

Как показано выше, вопрос о полученных письмах в Teams дает правильный ответ. Тот же вопрос в Copilot в OneDrive приводит к ответу: «Кажется, сегодня писем не поступало. Если у вас есть другие вопросы или нужна помощь с чем-то еще, дайте знать!» — что совершенно неверно.

По материалам No Jitter.

Оставить комментарий