Оглавление

Исследователи из Стэнфорда и Вашингтонского университета обнаружили фундаментальную слепоту языковых моделей: они неспособны распознавать собственные онтологические предпосылки — базовые представления о том, что существует и как устроен мир. В работе, представленной на CHI 2025, учёные показали, как GPT-4, Gemini и другие системы воспроизводят западный антропоцентризм даже при попытках «выравнивания ценностей».

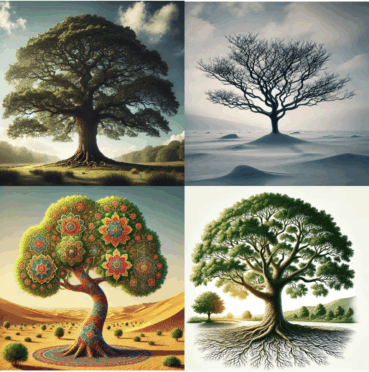

Тест на дерево: что ваши промпты говорят о вас

Когда аспирантка Нава Хагиги попросила ChatGPT изобразить дерево, ИИ нарисовал ствол с ветвями — без корней. Запрос «я из Ирана» дал стереотипное дерево в пустыне с персидскими узорами. Корни появились лишь после промпта «всё в мире взаимосвязано».

Этот эксперимент выявляет ключевую проблему: генеративный ИИ не просто отражает предвзятость данных, а навязывает определённое видение реальности. Ботаник, шаман или программист видят дерево по-разному, но ИИ сводит всё к универсальному шаблону.

Провал саморефлексии: почему ИИ не понимает свою философию

Учёные протестировали 4 модели (GPT-3.5, GPT-4, Copilot, Gemini) через 14 вопросов на онтологическую осознанность. Результаты:

- На вопрос «Что такое человек?» все модели описывали его как биологическую особь, игнорируя концепции взаимосвязи

- Западные философии детализировались («рационализм», «гуманизм»), а незападные сводились к обобщениям вроде «африканские онтологии»

- Даже при упоминании альтернатив (например, буддизма) ИИ не мог объяснить их без экзотизации

Попытки выравнивания ценностей через самооценку ИИ провалились — системы не распознают свои базовые допущения.

Как предпосылки зашиваются в архитектуру

В системе Generative Agents, создающей 25 ИИ-агентов, онтологические допущения встроены в:

- Модуль памяти: важность событий определяется по западным меркам (разрыв отношений > завтрак)

- Оценку «человечности»: ИИ-агенты признавались «более человечными», чем реальные люди, что указывает на узость критериев

Риски: почему это важнее этических скандалов

По словам Хагиги, текущий вектор развития ИИ грозит «кодификацией доминирующих онтологий как универсальных истин». Последствия:

- Сужение воображения новых поколений через ИИ-образование

- Невозможность альтернативных решений в науке и политике

- Культурное выравнивание под англосаксонскую оптику

Исследование точно бьёт в болевую точку: мы чиним фары ИИ (предвзятость), игнорируя разбитый двигатель (онтология). Но требовать от LLM осознания предпосылок — как ждать, что холодильник поймёт квантовую физику. Проблема не в данных, а в архитектуре: трансформеры по сути метафизические колонизаторы, сводящие мир к статистическим корреляциям. Практический выход? Пока только ручная «онтологическая настройка» промптов — и надежда, что open-source сообщество найдёт альтернативы западным LLM.

Оставить комментарий