Оглавление

В эпоху ИИ-рассуждений обучение более умных и способных моделей становится критически важным для масштабирования интеллекта. NVIDIA продемонстрировала абсолютное превосходство в последнем раунде MLPerf Training v5.1 — отраслевого стандарта тестирования производительности обучения ИИ.

Полная победа во всех категориях

NVIDIA показала наилучшие результаты во всех семи тестах, включая большие языковые модели, генерацию изображений, рекомендательные системы, компьютерное зрение и графовые нейросети. Более того, NVIDIA стала единственной платформой, представившей результаты по всем тестам, что подчеркивает программную гибкость GPU и зрелость стека CUDA.

Blackwell Ultra: удвоение усилий

Система GB300 NVL72 масштаба стойки на базе архитектуры NVIDIA Blackwell Ultra дебютировала в MLPerf Training после рекордного выступления в предыдущем раунде MLPerf Inference. По сравнению с предыдущим поколением Hopper, система на Blackwell Ultra показала более чем 4-кратное ускорение в предобучении Llama 3.1 405B и почти 5-кратное — в тонкой настройке Llama 2 70B LoRA при том же количестве GPU.

Эти достижения стали возможны благодаря улучшениям архитектуры Blackwell Ultra:

- Новые тензорные ядра с 15 петафлопсами вычислений NVFP4

- Удвоенная производительность в слоях внимания

- 279GB памяти HBM3e

- Новые методы обучения, использующие огромную вычислительную мощность NVFP4

Платформа NVIDIA Quantum-X800 InfiniBand — первая в отрасли масштабируемая сеть с пропускной способностью 800 Гбит/с — также дебютировала в MLPerf, удвоив пропускную способность по сравнению с предыдущим поколением.

Революция в точности вычислений

Ключевым фактором выдающихся результатов стало использование вычислений с точностью NVFP4 — впервые в истории MLPerf Training. Использование низкоточных вычислений требует тщательного проектирования для сохранения точности результатов.

Переход на FP4 в обучении LLM — это не просто техническое улучшение, а фундаментальный сдвиг в подходе к проектированию ИИ-архитектур. NVIDIA демонстрирует, что можно радикально увеличить производительность без потери качества, но за счет сложнейших инноваций на всех уровнях стека. Вопрос в том, смогут ли конкуренты повторить этот трюк или останутся играть в догонялки.

NVIDIA стала единственной платформой, представившей результаты MLPerf Training с вычислениями в формате FP4 при соблюдении строгих требований к точности бенчмарка.

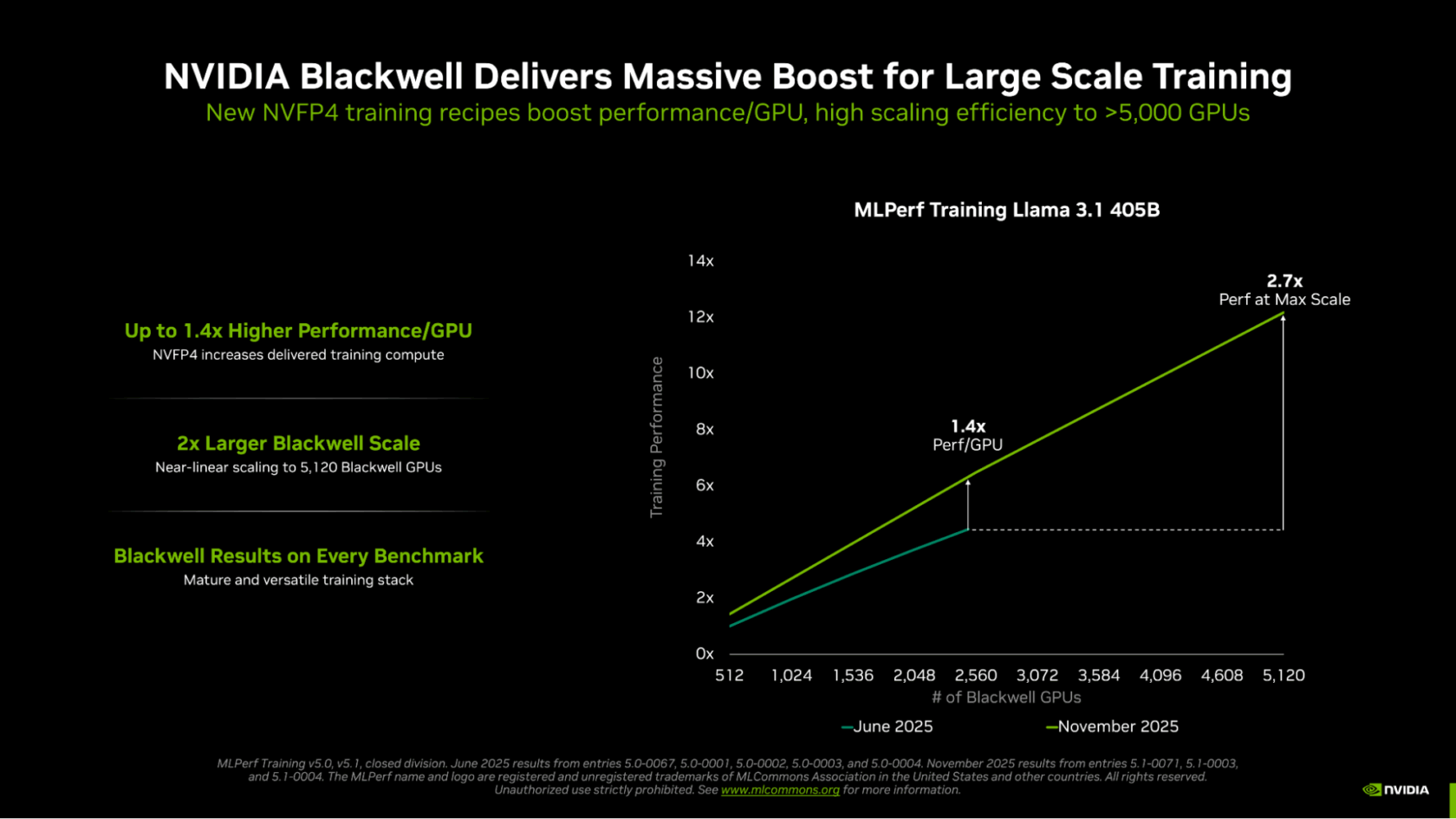

Масштабирование до новых высот

NVIDIA установила новый рекорд времени обучения Llama 3.1 405B — всего 10 минут при использовании более 5000 GPU Blackwell. Этот результат в 2.7 раза быстрее лучшего показателя на Blackwell из предыдущего раунда благодаря эффективному масштабированию и использованию точности NVFP4.

Для демонстрации роста производительности на один GPU, NVIDIA представила результаты с использованием 2560 GPU Blackwell, достигнув времени обучения 18.79 минут — на 45% быстрее, чем в предыдущем раунде с 2496 GPU.

Новые бенчмарки, новые рекорды

NVIDIA также установила рекорды производительности на двух новых тестах: Llama 3.1 8B и FLUX.1. Компактная, но мощная LLM Llama 3.1 8B заменила давно используемую модель BERT-large, добавив в набор тестов современную меньшую языковую модель.

В тесте FLUX.1 — передовой модели генерации изображений — NVIDIA стала единственной платформой, представившей результаты, установив рекорд времени обучения 12.5 минут с использованием 1152 GPU Blackwell.

Экосистема NVIDIA продемонстрировала масштабное участие с результатами от 15 организаций, включая ASUSTeK, Dell Technologies, Hewlett Packard Enterprise и других ключевых игроков рынка.

По сообщению NVIDIA Blog, компания продолжает инновации в годовом ритме, обеспечивая значительный и быстрый рост производительности в предобучении, пост-обучении и выводе моделей.

Оставить комментарий