Оглавление

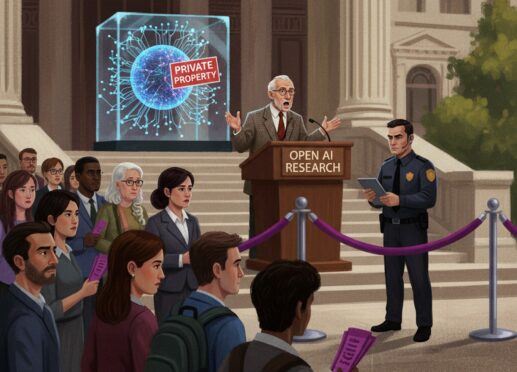

Корпоративные лаборатории ИИ закрываются для публичного обмена знаниями, и теперь именно академические институты должны подхватить знамя открытой науки — иначе прогресс в искусственном интеллекте замедлится до уровня корпоративных секретов.

Открытая наука как общественное благо

Десять лет назад Марк Цукерберг неожиданно появился на академической конференции NeurIPS, объявив о запуске подразделения Facebook* по фундаментальным исследованиям ИИ (FAIR). Это стало сигналом, что исследования ИИ перескочили из университетских лабораторий в сердце Big Tech.

Сегодня же ситуация кардинально изменилась: Meta* объявила о резких сокращениях в FAIR, даже несмотря на то, что ИИ превратился в триллионную глобальную индустрию. DeepMind больше не публикует технические детали своих ведущих моделей ИИ и ввела шестимесячные эмбарго с более строгим внутренним рецензированием статей для сохранения конкурентного преимущества. OpenAI теперь превратился в ClosedAI и, как другие корпоративные лаборатории, все чаще предпочитает технические блоги и внутренние релизы продуктов вместо рецензируемых публикаций или открытого исходного кода.

Волна открытости в ИИ отступает — а вместе с ней и основа самого научного прогресса.

Открытая наука — это прежде всего общественное благо, знание, которое приносит пользу всем, а не избранным. Когда исследования открыто делятся, инновации ускоряются, дублирование минимизируется, а идеи строятся друг на друге. В исследованиях ИИ общие инструменты с открытым исходным кодом, наборы данных, библиотеки и бенчмарки обеспечили прогресс, который зародился в одной лаборатории и распространился по всему миру — от студентов до стартапов и крупных промышленных развертываний.

Но когда знания об ИИ становятся приватизированными, мы теряем не только прозрачность: мы теряем перекрестное опыление идей, которое движет подлинным научным прогрессом. Университеты и государственные институты уникально расположены для поддержания этой роли общественного блага, поскольку они не структурированы в первую очередь вокруг возврата для акционеров или запуска продуктов; они могут отдавать приоритет открытости, воспроизводимости, подготовке кадров и глобальному участию.

Как открытость построила современный ИИ

История искусственного интеллекта неотделима от истории открытой науки:

- Алгоритм обратного распространения ошибки, впервые открыто опубликованный в 1980-х годах, позволил возрождение глубокого обучения

- Успешные методы глубокого обучения были затем разработаны в университетах, особенно для распознавания речи и изображений в лаборатории Джеффри Хинтона в Университете Торонто

- Открытые наборы данных, такие как TIMIT, TREC, MNIST, ImageNet и Stanford Alpaca, предоставили воспроизводимые бенчмарки и общую основу для прогресса ИИ

- Код/библиотеки с открытым исходным кодом, такие как Stanford CoreNLP, а позже TensorFlow, PyTorch и FlashAttention, предлагали бесплатный доступ к передовым методам

- Общие бенчмарки и соревнования (например, GLUE, соревнования ImageNet) обучали поколения исследователей и инженеров ИИ

Эта экосистема создала маховик инноваций: исследователи публиковали код и данные, другие использовали и улучшали их; студенты учились на этом; стартапы и индустрия переводили эти достижения в продукты. Это было не случайно — это была функция общественного блага открытой науки в действии. В этом контексте нынешний корпоративный отход от открытости вызывает беспокойство. Это сигнализирует о сдвиге от науки как общего начинания к исследованиям как проприетарной продуктовой стратегии.

Отступление индустрии и провал рынка талантов

Отход от открытой науки понятен: корпоративные лаборатории ИИ сталкиваются с огромным коммерческим давлением и ожесточенной конкуренцией. Модели дороги, исследования стоят дорого, а преимущество первопроходца имеет значение. Тем не менее, этот сдвиг имеет более широкие последствия для общественного блага и образования.

Один яркий показатель — рынок талантов: сообщения предполагают, что Meta* Platforms предлагала подписные бонусы порядка 100 миллионов долларов или больше ведущим исследователям ИИ в отчаянной попытке заполучить элитные таланты.

Это означает провал рынка университетов — институтов, которые должны готовить следующее поколение талантов, просто не хватает вычислительных мощностей, данных, а также правильного баланса исследователей и инженеров-программистов для удовлетворения спроса на экспертов в разработке больших моделей ИИ. Работа студентов-исследователей в составе этих больших команд — правильный способ изучения этих важных навыков. Если университеты не могут обучать студентов так, как требуется для будущих работ, то мы теряем не только индивидуальные возможности, но и более широкий кадровый потенциал, необходимый для инноваций и исследований общественного блага.

Момент университетов и общественное благо открытости

Сейчас настал момент для университетов вновь утвердить свою историческую роль в продвижении ИИ как общественного блага. Академическое сообщество и некоммерческий сектор имеют возможность отдавать приоритет открытости, этике, общей инфраструктуре и глобальному доступу над краткосрочными коммерческими выгодами.

Это означает инвестирование в инициативы открытых данных и открытых моделей, которые остаются свободно доступными для исследований и образования; создание глобальных партнерств, которые делятся вычислениями, данными и опытом через границы и дисциплины — чтобы знания не были заперты всего в нескольких компаниях или странах; и развитие междисциплинарной командной науки, которая интегрирует социальные науки, этику, дизайн вместе с техническими исследованиями ИИ, чтобы гарантировать, что ИИ служит человеческим потребностям и общественным ценностям.

Университеты должны не только публиковать, но и поддерживать экосистему общественного блага, которую представляет открытая наука. Делая это, они сохраняют основу развития талантов и открытий, которая питает каждый прорыв в ИИ.

Парадокс в том, что университеты, создавшие фундамент современного ИИ, теперь проигрывают в гонке за таланты тем самым корпорациям, которые выросли на их же исследованиях. Ситуация напоминает курицу, несущую золотые яйца, которую заставляют платить за собственные яйца.

Передача эстафеты вперед

В Стэнфордском институте человеко-центричного искусственного интеллекта (HAI) считают, что следующая глава ИИ должна сочетать научную открытость с человеко-центричными ценностями, такими как достоинство, равенство и общее благо. В то время как индустрия отдает приоритет продукту и конкурентному преимуществу, наша цель — культивировать сеть глобальных сотрудничеств между единомышленниками университетами, правительствами, некоммерческими организациями и отраслевыми партнерами, которые поддерживают миссию общественного блага. Речь идет не о брендинге или конкуренции — речь идет об управлении институтами и практиками открытой науки.

Самые важные проблемы, стоящие перед миром, требуют нового подхода к научным исследованиям: командной науки. Командная наука требует не только более масштабных сотрудничеств междисциплинарных академических исследователей и инженеров-программистов, которые сегодня есть только у индустрии, но также вычислений и данных для этого. Нам нужны новые академические модели для реализации прорывов, которые откроет командная наука: распределенные университетские исследовательские центры, соединенные через континенты, которые разделяют лидерство, данные, вычисления, модели и профессиональные таланты. Работа в этих центрах будет сосредоточена на человеческом процветании, а не на коммерческой эксклюзивности.

Вопрос в том, восстановим ли мы институты открытой науки, которые сделали ИИ возможным в первую очередь — или позволим им быть размытыми концентрированной коммерческой властью. У нас есть мимолетная возможность формировать траекторию ИИ, прежде чем он сформирует нас.

По материалам Stanford HAI

*Meta признана экстремистской и запрещена в РФ

Оставить комментарий