Оглавление

Современное высшее образование столкнулось с парадоксальной ситуацией: студенты используют искусственный интеллект не только для выполнения заданий, но и для написания извинений за списывание. Как пишет Ars Technica, в Университете Иллинойса преподаватели обнаружили массовое использование ChatGPT для генерации покаянных писем.

Система обмана и её разоблачение

Курс «Data Science Discovery» с более чем тысячей студентов использовал инструмент Data Science Clicker для отслеживания посещаемости. Студенты сканировали QR-код во время лекции и отвечали на вопросы с ограничением по времени — около 90 секунд. Однако профессора Карл Фланаган и Уэйд Фейген-Ульмшнайдер обнаружили, что количество ответов значительно превышает реальное число присутствующих в аудитории.

Расследование показало, что студенты координировали действия через сообщения, предупреждая друг друга о времени появления вопросов. Преподаватели проверили данные о частоте обновления страниц и IP-адресах устройств, что подтвердило масштабный обман.

ИИ-извинения как новый тренд

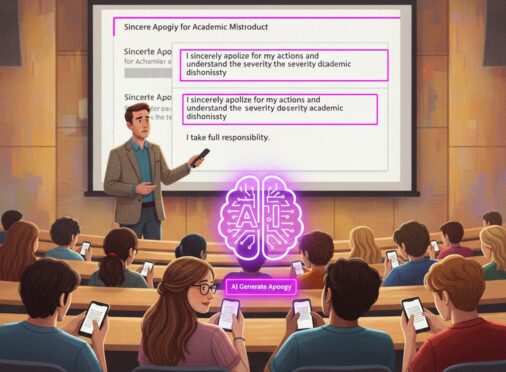

Когда профессора обратились к примерно сотне студентов с просьбой объяснить свои действия, они получили поток извинений. Первоначально преподаватели были тронуты проявлением ответственности, но быстро поняли, что 80% писем содержат идентичные формулировки с фразой «искренне извиняюсь» — явный признак использования языковых моделей.

17 октября во время занятия преподаватели продемонстрировали собранные примеры идентичных извинений, но не стали применять дисциплинарные меры, рассматривая ситуацию как «жизненный урок».

Проблема в том, что студенты курса по науке о данных не смогли скрыть следы использования алгоритмов — именно то, чему их должны были научить. Если даже извинения за списывание генерирует ИИ, возникает вопрос: что вообще остаётся от человеческого в образовательном процессе?

Масштабы проблемы в студенческой среде

На университетском сабреддите студенты и ассистенты поделились дополнительными наблюдениями:

- Использование ИИ для решения относительно простых задач

- Применение функций, не изучавшихся в курсе, что сразу выдавало использование внешних инструментов

- Генерация даже коротких персональных размышлений через языковые модели

Один из ассистентов отметил, что «примерно 75% сданных работ содержат ИИ-мусор», что отражает масштаб проблемы.

Двойные стандарты и ложные обвинения

Проблема усугубляется ненадёжностью инструментов детекции ИИ. Многие студенты жалуются на необоснованные обвинения в использовании искусственного интеллекта, когда они работали самостоятельно. Это создаёт атмосферу взаимного недоверия между преподавателями и студентами.

Ситуация демонстрирует фундаментальную проблему современного образования: с одной стороны, ИИ действительно может быть полезным инструментом для исследований и анализа данных, с другой — его бесконтрольное использование подрывает саму суть образовательного процесса.

Преподаватели надеются, что этот случай станет поводом для переосмысления роли технологий в обучении. Как отметил Фейген-Ульмшнайдер, важно не запрещать технологии, а научиться использовать их ответственно, сохраняя при этом критическое мышление и личную вовлечённость.

Оставить комментарий