Оглавление

Google Research сообщает, что в мобильном фоторедакторе Snapseed для iOS появилась новая функция Object Brush, позволяющая выделять и редактировать объекты на фотографиях простым касанием. Технология основана на модели Interactive Segmenter, которая работает полностью на устройстве без подключения к интернету.

Интуитивное редактирование через интерактивную сегментацию

Новая кисть объектов в инструменте «Adjust» позволяет пользователям просто провести пальцем по нужному объекту, после чего ИИ-модель автоматически определяет его границы и создает маску для изолированного редактирования. Весь процесс занимает менее 20 миллисекунд благодаря использованию фреймворка MediaPipe и GPU-ускорения через LiteRT.

Модель генерирует точные маски для любых объектов — людей, животных, элементов пейзажа — с возможностью мгновенного уточнения выделения добавлением или удалением областей.

Архитектура и обучение модели

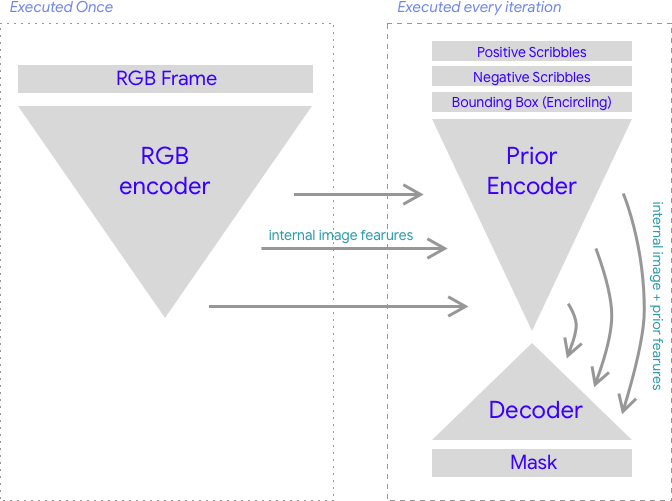

Interactive Segmenter построена по принципу двухкомпонентной системы: тяжелый кодировщик изображений запускается один раз для извлечения семантических признаков, а легкий интерактивный энкодер-декодер обрабатывает пользовательские жесты и генерирует маску сегментации за 7.4 мс на iPhone 16 Pro.

Метод обучения

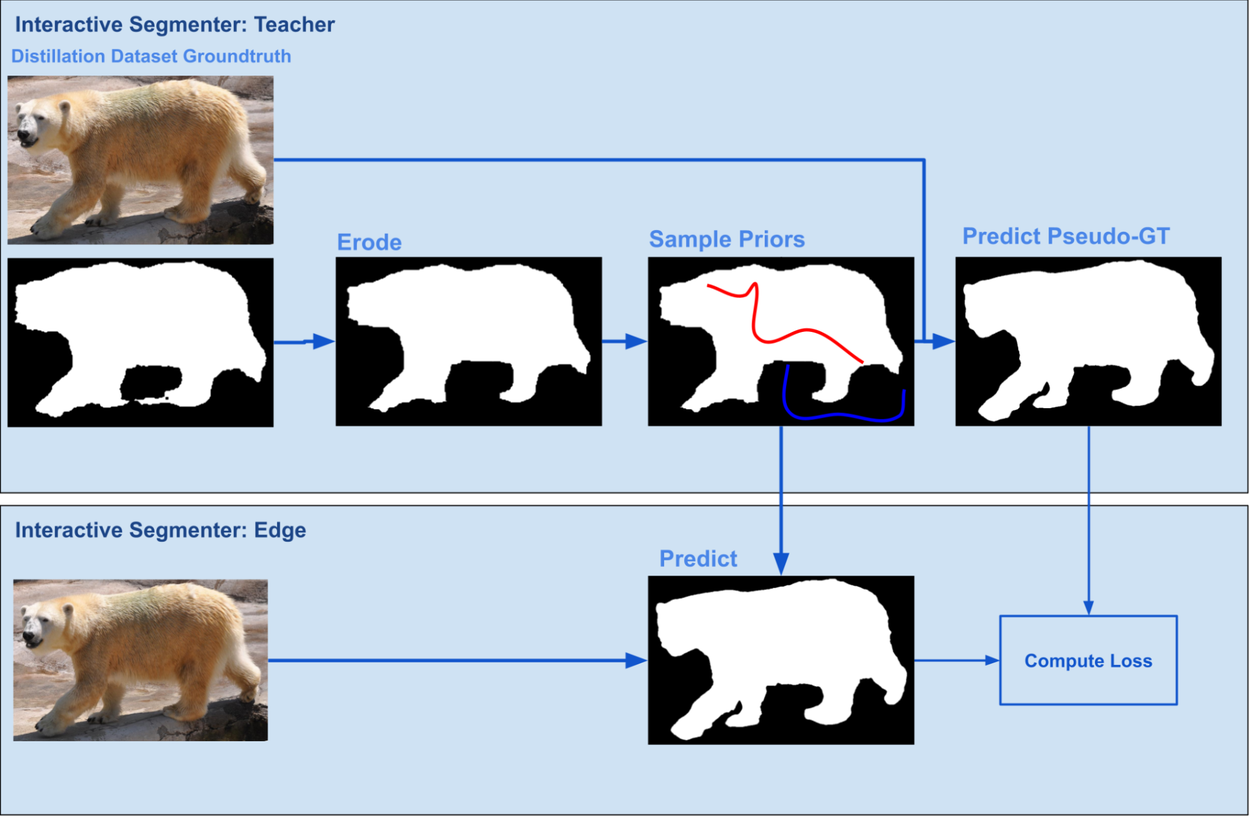

Для обучения использовался подход Big Transfer с предобученным изображений-энкодером. Сначала создали «учительскую» модель на 30,000 высококачественных масок, затем через дистилляцию знаний перенесли ее возможности на компактную «ученическую» модель для мобильных устройств.

Для генерации промптов имитировали пользовательское поведение: случайные штрихи внутри маски (выделение объекта) и снаружи (исключение фона), а также точечные касания и рамки выделения.

Баланс качества и скорости

Ключевым вызовом было совмещение высокого качества сегментации с интерактивной скоростью отклика. Решение — разделение на тяжелый кодировщик изображений (запускается один раз) и легкий интерактивный модуль (работает в реальном времени).

Задержка вывода при работе Interactive Segmenter: Edge на устройстве демонстрирует стабильную производительность даже на высоком разрешении.

Для работы с высококачественными изображениями модель предсказывает маску в разрешении 768×768 с последующим апскейлингом до 4K через эффективный GPU-реализованный метод совместной двусторонней повышающей дискретизации.

Технически впечатляющая реализация, но стоит отметить, что подобные технологии сегментации уже несколько лет существуют в профессиональных десктопных редакторах. Интересно именно сочетание мобильности, скорости и качества — типичный кейс для Google, где академические исследования быстро превращаются в массовые продукты. Вопрос в том, насколько эта технология масштабируема на более слабые устройства и как поведет себя с нестандартными объектами в реальных условиях.

Оставить комментарий