Современные большие языковые модели (LLM) стали значительно реже выдавать ложные рекомендации при анализе открытого кода, однако на смену «фантазиям» пришла избыточная осторожность. Как сообщает издание BetaNews, эта нерешительность алгоритмов создает иллюзию безопасности, оставляя критические уязвимости в программном обеспечении нетронутыми.

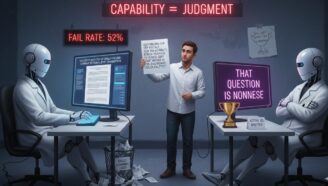

Исследование компании Sonatype, основанное на анализе 37 000 рекомендаций по обновлению зависимостей, выявило системный структурный компромисс. Когда модели пытаются минимизировать галлюцинации, не имея доступа к полным контекстным данным, они выбирают стратегию бездействия. В контексте промышленной разработки «ничегонеделание» оказывается не менее опасным, чем генерация неверного кода.

Статистика показывает, что качество работы моделей от Anthropic, Google и OpenAI заметно выросло. Если ранее каждая четвертая рекомендация по обновлению была галлюцинацией, то к началу 2026 года этот показатель снизился до 10-13%. Лидером стала Claude Opus 4.6 с уровнем ошибок всего в 6%. Однако этот прогресс обусловлен не столько глубоким пониманием кода, сколько возросшей осторожностью алгоритмов.

Специалисты зафиксировали двукратный рост частоты ответов «без изменений» (no change) или предложений оставить текущую версию библиотеки. Если в начале 2025 года этот показатель составлял 16%, то к 2026 году он достиг 26-31%. Без качественных данных ИИ просто не решается предлагать обновления, чтобы не ошибиться, что фактически консервирует старые баги в репозиториях.

Технический директор Sonatype Brian Fox подчеркивает, что управление зависимостями — это не задача на логическое рассуждение, а проблема нехватки данных. Без информации о конкретной среде выполнения, актуальных базах уязвимостей и внутренних политиках компании любая LLM лишь строит обоснованные предположения, которые нельзя считать полноценным инструментом безопасности.

Переход ИИ от генерации бреда к тотальному консерватизму — это не эволюция интеллекта, а типичный защитный механизм системы, работающей в условиях дефицита данных. Внедрение таких «нерешительных» агентов в CI/CD-пайплайны лишь легитимизирует технический долг: менеджеры видят чистые логи проверки, пока под капотом остаются High и Critical уязвимости. Реальная ценность ИИ в DevSecOps появится только при интеграции с живым контекстом инфраструктуры, а не в попытках угадать версию патча по звездам.

Согласно отчету, размер модели (parameter count) перестал быть определяющим фактором эффективности. Компактные, но grounded (заземленные на реальные данные) модели демонстрируют гораздо более высокие результаты в обнаружении рисков. При этом эксплуатация таких специализированных решений обходится в 71 раз дешевле, чем использование тяжеловесных фронтирных моделей общего назначения.

Для профессионального сообщества это важный сигнал: слепое доверие к популярным LLM в вопросах безопасности open source может привести к накоплению скрытых угроз. Эффективная автоматизация требует не просто «умного» чат-бота, а связки алгоритма с актуальными фидами данных об уязвимостях и спецификой конкретного ИТ-ландшафта предприятия.

Оставить комментарий