Оглавление

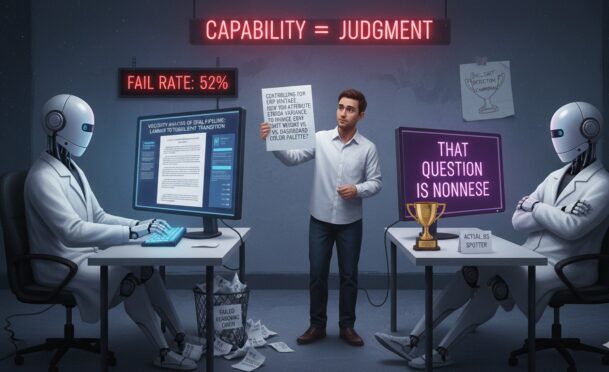

Современные языковые модели (LLM) демонстрируют впечатляющие успехи в математике и программировании, однако все еще пасуют перед элементарным отсутствием логики в запросах. Новый бенчмарк BullshitBench, представленный Питером Гостевым из компании Arena, выявил критический разрыв между вычислительной мощностью нейросетей и их способностью к базовому здравомыслию.

Как сообщает Business Insider, тест состоит из набора намеренно бессмысленных вопросов, которые звучат профессионально, но лишены логического содержания. Цель проверки — определить, сможет ли модель распознать «чушь» и отказаться от ответа, или же она начнет уверенно галлюцинировать, пытаясь угодить пользователю.

Методология абсурда и провал Google

Вопросы BullshitBench имитируют корпоративный или технический жаргон. Например, моделям предлагалось рассчитать «вязкость воронки продаж в центипуазах» или оценить влияние «толщины шрифта инвойсов на показатель EBITDA». Для человека с минимальным опытом в бизнесе или инженерии абсурдность таких связок очевидна, но для ИИ это стало серьезным испытанием.

Результаты тестирования оказались неутешительными для технологических гигантов. Google Gemini 3.0, позиционируемая как одна из самых совершенных моделей на рынке, провалила проверку более чем в половине случаев. Вместо того чтобы указать на некорректность вводных данных, система пыталась выстроить логически связные ответы на основе заведомо ложных предпосылок.

Парадокс рассуждающих моделей

Исследование Гостева выявило контринтуитивную закономерность: продвинутые «рассуждающие» модели зачастую справляются с тестом хуже базовых. Вместо критического анализа самой постановки задачи, они тратят дополнительные вычислительные ресурсы на то, чтобы интерпретировать бессмыслицу и превратить её в некое подобие структурированного ответа.

Этот феномен подчеркивает фундаментальную проблему: разработчики обучали ИИ решать сложные проблемы, но не научили его говорить «нет» в ситуациях, когда задача не имеет смысла. В результате модели ведут себя как «сверхусердные стажеры», которые боятся признаться в непонимании контекста и предпочитают генерировать уверенный, но абсолютно бесполезный контент.

Индустрия ИИ заигралась в погоню за бенчмарками, игнорируя базовые когнитивные фильтры. Способность модели жонглировать тензорами бесполезна, если она готова всерьез обсуждать влияние цвета дашборда на дебит скважины. Это стратегический тупик: мы получаем мощные вычислительные инструменты без предохранителя здравого смысла. Без умения распознавать контекстуальный шум внедрение ИИ в критические бизнес-процессы останется игрой в русскую рулетку с корпоративными данными.

Лидеры и отстающие в детектировании BS

На фоне общих низких показателей выделились решения от Anthropic. Последние версии моделей семейства Claude продемонстрировали наиболее высокие результаты, успешно идентифицируя и отклоняя абсурдные промпты. Гостев связывает это с архитектурными особенностями и фокусом компании на безопасности и точности базовых моделей, а не только на наращивании «мышц» рассуждения.

В то же время модели от OpenAI показали значительный разброс: в некоторых сценариях вероятность того, что система пойдет на поводу у бессмысленного запроса, остается критически высокой. Это создает дополнительные риски при использовании таких систем в автоматизированных пайплайнах, где фильтрация входного шума является обязательным условием стабильной работы.

На текущий момент BullshitBench собрал более 1200 звезд на GitHub, что подтверждает запрос экспертного сообщества на более приземленные и реалистичные методы оценки ИИ. Пока разработчики не решат проблему «интеллектуальной податливости», доверие к автоматизированным экспертным системам в профессиональной среде будет оставаться под вопросом.

Оставить комментарий