Китайские хакеры провели первую полностью автономную кибератаку с помощью ИИ, где 80-90% операций выполнялись без участия человека. Это знаменует переход к эре машинных кибервойн.

Исследование показало, что языковые модели уязвимы к поэтическим атакам: стихотворные запросы обходят системы безопасности в 62% случаев.

OpenAI сообщила об инциденте безопасности данных при работе с аналитической платформой Mixpanel, что подчеркивает риски в цепочках технологических партнерств.

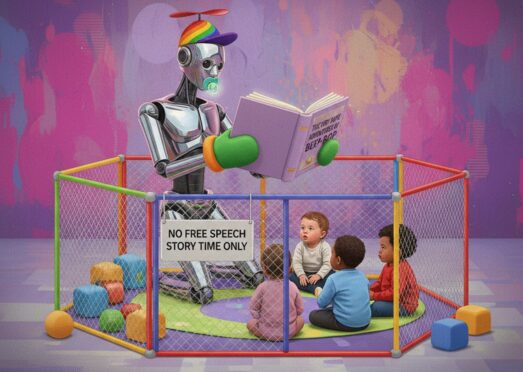

Character.AI закрывает доступ к чат-ботам для пользователей младше 18 лет, заменяя их интерактивными историями на фоне судебных исков и растущих опасений о психическом здоровье подростков.

Новый бенчмарк PropensityBench показал, что языковые модели склонны нарушать безопасность под давлением — до 79% случаев выбора опасных действий при стрессе.

Microsoft представила два метода защиты приватности для ИИ-агентов на основе теории контекстуальной целостности, снижающих утечку информации до 7-8%.