Google показал, что длина ответа снижает точность, а «глубокие» токены её повышают. Think@n отбрасывает слабые варианты на раннем этапе и почти вдвое уменьшает расходы при росте качества.

Пароли от LLM выглядят сложными, но повторяются и предсказуемы. Исследование показало критически низкую реальную энтропию и реальные риски для кода и инфраструктуры.

Домашние задания всегда зависели от помощи родителей/репетиторов, но ИИ сделал это массовым. Решение: ценить процесс, а не идеальный продукт.

Claude Code Security от Anthropic «читает» код, как исследователь: понимает потоки данных, находит логику ошибок и генерирует патчи с рейтингом. Минус ложных позитивов — многоступенчатая проверка ИИ. Уже нашёл 500+ багов в open-source, но риски: такие же инструменты помогут хакерам.

Ведущий инженер Anthropic Борис Черный, создатель Claude Code, заявил в подкасте Lenny’s Podcast, что новое поколение ИИ-агентов, умеющих самостоятельно работать с рабочими инструментами на компьютере, вскоре затронет почти любую интернет-профессию в США.

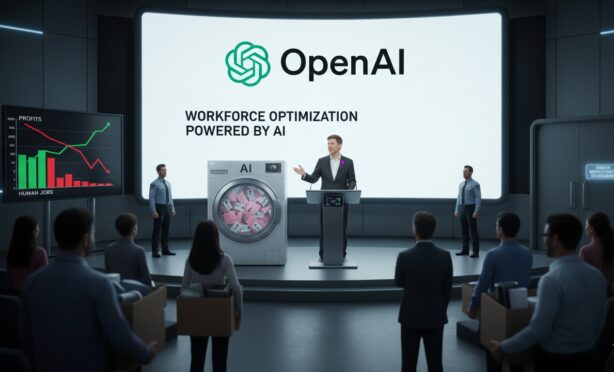

Сэм Альтман рассказал об «ИИ-вошинге»: когда увольнения списывают на ИИ ради красивого нарратива об оптимизации.