OpenAI отключила систему автоматического выбора моделей ИИ для бесплатных пользователей ChatGPT, вернувшись к единой быстрой модели. Причина — нетерпеливость пользователей и высокая стоимость «умных» моделей.

Исследователи MIT-IBM представили PaTH Attention — новую технику позиционного кодирования для трансформеров, которая делает понимание контекста адаптивным и улучшает способность моделей к последовательному рассуждению в длинных текстах.

OpenAI представила GPT Image 1.5 — модель для редактирования изображений через текстовые запросы. Инструмент позволяет легко изменять фотографии, сохраняя лица, и является ответом на успех Google с Nano Banana.

OpenAI открыла магазин приложений для ChatGPT, позволяя разработчикам публиковать свои кастомизированные GPTs после верификации и модерации. Новый раздел доступен пользователям платных подписок.

LiteCoder-Terminal-Preview — семейство компактных моделей для работы в терминале, обучаемых менее чем на 1000 примеров. Они показывают конкурентные результаты, бросая вызов парадигме больших данных в машинном обучении.

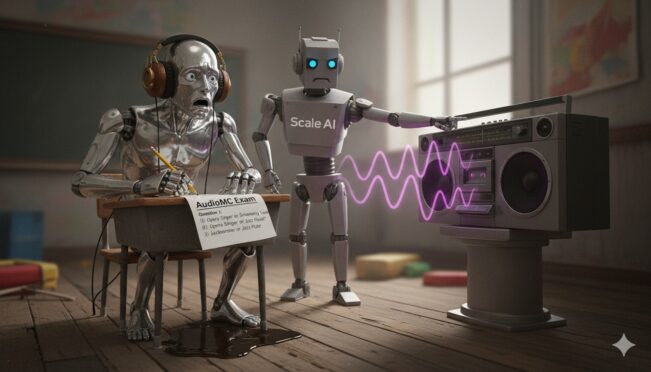

Scale представила бенчмарк Audio MultiChallenge, который тестирует голосовые ИИ на реалистичных диалогах с исправлениями и паузами. Лидером стал Gemini 3 Pro, а GPT-4o значительно отстал.